超簡単!画像生成AI 「Stable Diffusion」の導入と環境構築方法

こんにちは!SNS上でAI美女の投稿活動をしているグラビアアイドルAi(アイ)です。私がSNS上に投稿しているAI美女は「Stable Diffusion」という画像生成AIで生み出したものです。この記事では「Stable Diffusion」の最も簡単な導入方法と私と同水準のAI美女を生成するための環境構築について説明します。

この記事の通り進めれば一時間後には美女を生成できるようになっています!

高スペックPCがなくても導入できるし超簡単なので是非やってみて下さい!

はじめに

「Stable Diffusion」のWeb UI環境は最も人気があり拡張機能が豊富なAUTOMATIC1111と高速生成が売りのForgeがあります。2024年6月8日にForge公式より、AUTOMATIC1111のパフォーマンス改善を受けForgeは今後のアップデートで実験的なリポジトリになる旨のアナウンスがありました。(ほぼすべての拡張機能が壊れる可能性があるため普段使いはAUTOMATIC1111に戻すことが推奨されています)

要するに!これから初めて「Stable Diffusion」を導入するならAUTOMATIC1111一択ということになります。ここからは細かい説明は省いて私と同じ環境(AUTOMATIC1111)でクオリティの高いAI美女を生成するための最短ルートを説明していきます。

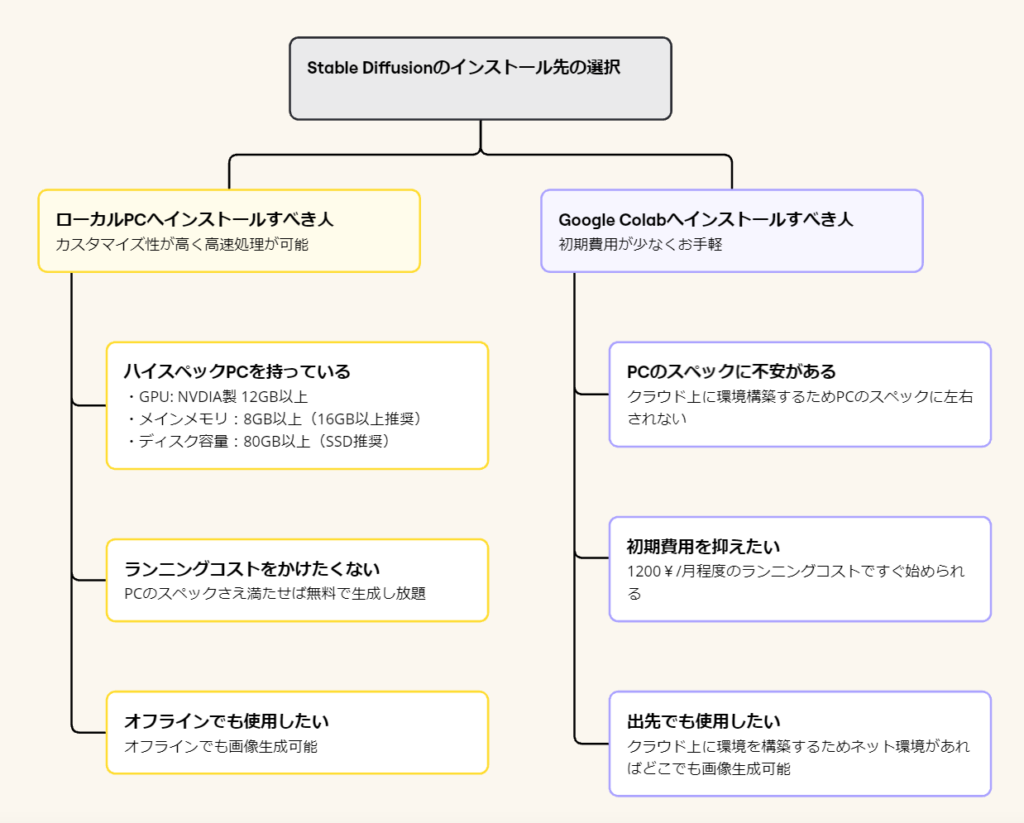

ローカルPC版とGoogle Colab版の説明をするので下図を参考にどちらで環境構築を進めるか選択してください。

ローカルPC版 導入と環境構築(ハイスペックPCをお持ちの方)

ローカルPCでの環境構築について説明します。Google Colabで環境構築される方は3章Google Colab版 導入と環境構築へ進んでください。

StabilityMatrixという簡単に「Stable Diffusion」を導入、管理できるツールを使って環境構築を進めていきます。

StabilityMatrixを使用した「Stable Diffusion」の導入

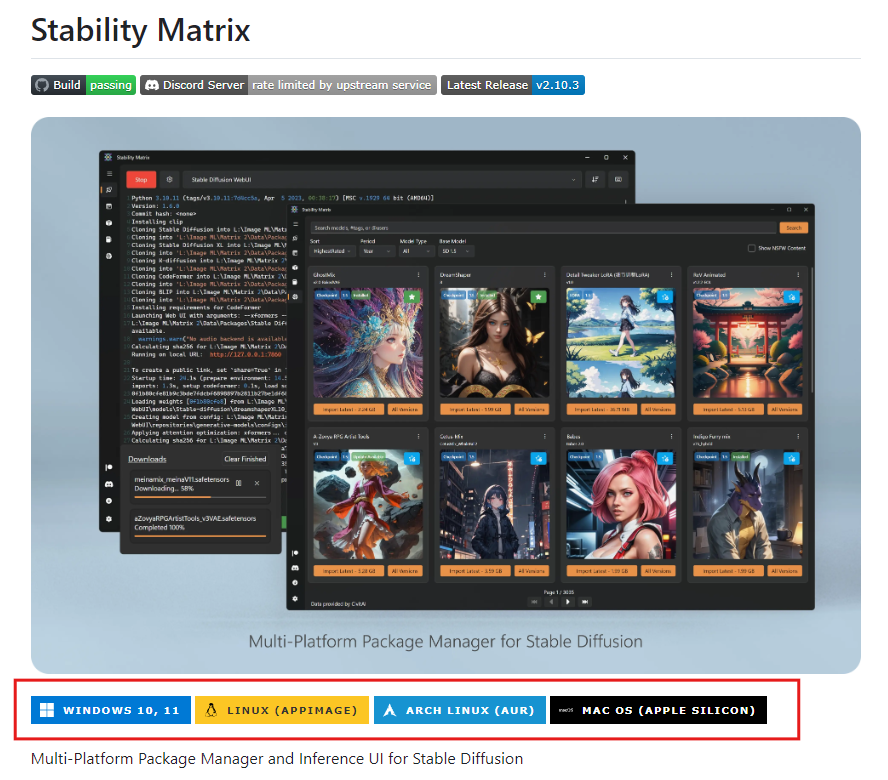

●下記リンク先(StabilityMatrixのgithubページ)へアクセスする

https://github.com/LykosAI/StabilityMatrix?tab=readme-ov-file

●適切なOS(windows、linux、MAC OS)をクリックしてダウンロードを開始する

●ダウンロードしたファイルを展開し、Stability Matrix.exeを起動する

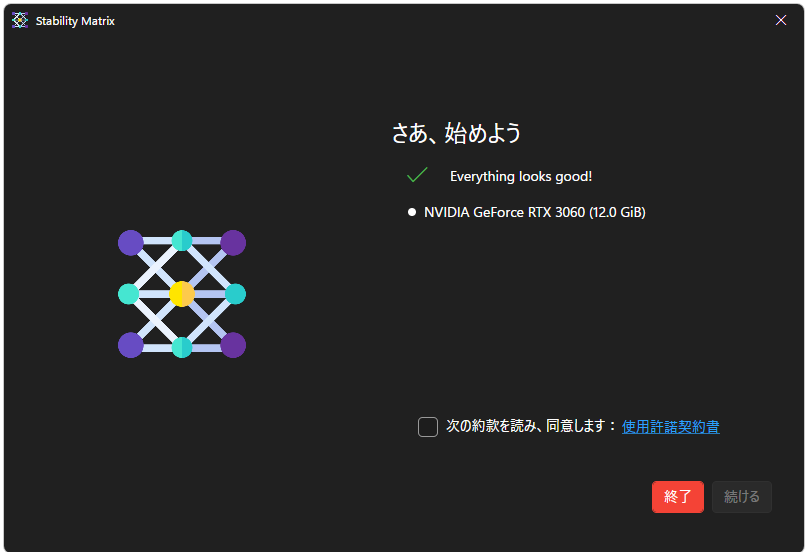

●使用許諾書の同意の✔して”続ける”をクリックする

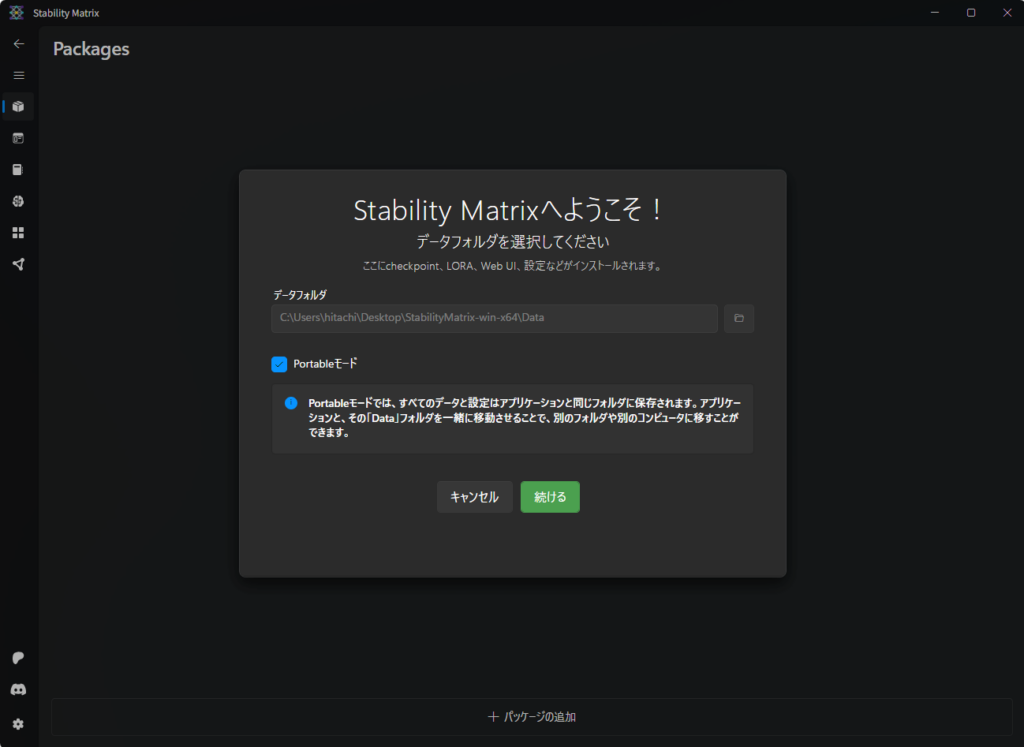

●データフォルダを選択して続けるをクリックする

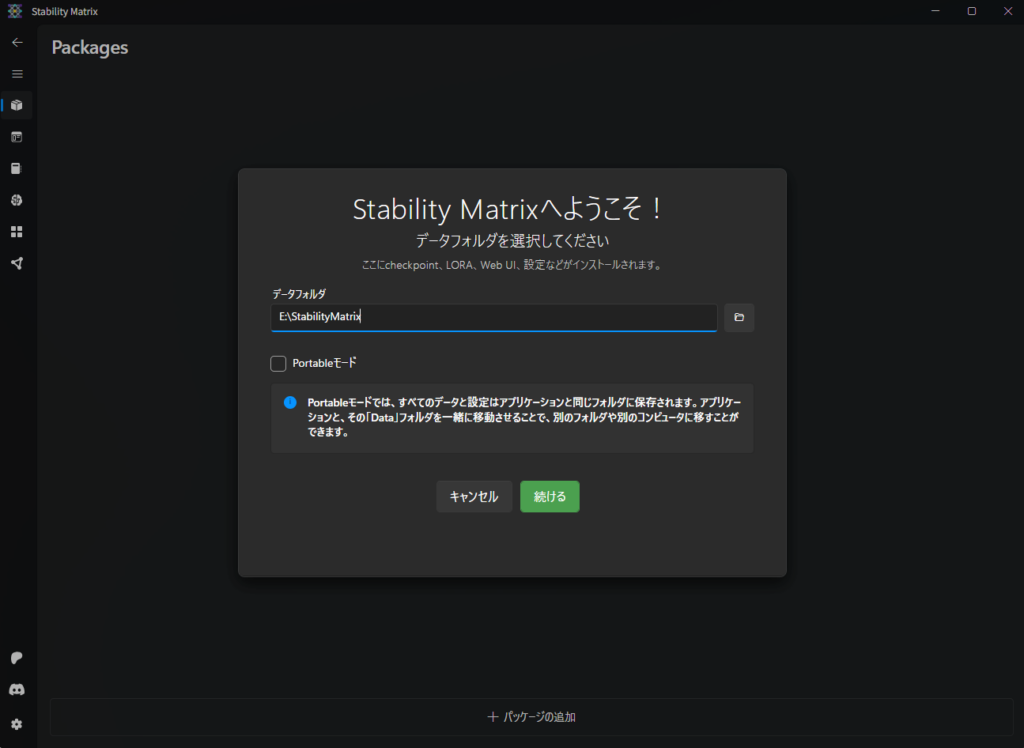

Portableモードを選択するとすべてのデータと設定が同じフォルダに保存されるメリットがありますが、保存先を任意に選択できなくなるデメリットがあります。私は任意の保存先(Eドライブに割り付けたSSD)にインストールしたかったためPortableモードは選択しませんでした。

Portableモードを選択した場合

任意のフォルダを選択した場合(Eドライブ直下に”StabilityMatrix”というフォルダを新規作成 パス:E:\StabilityMatrix)

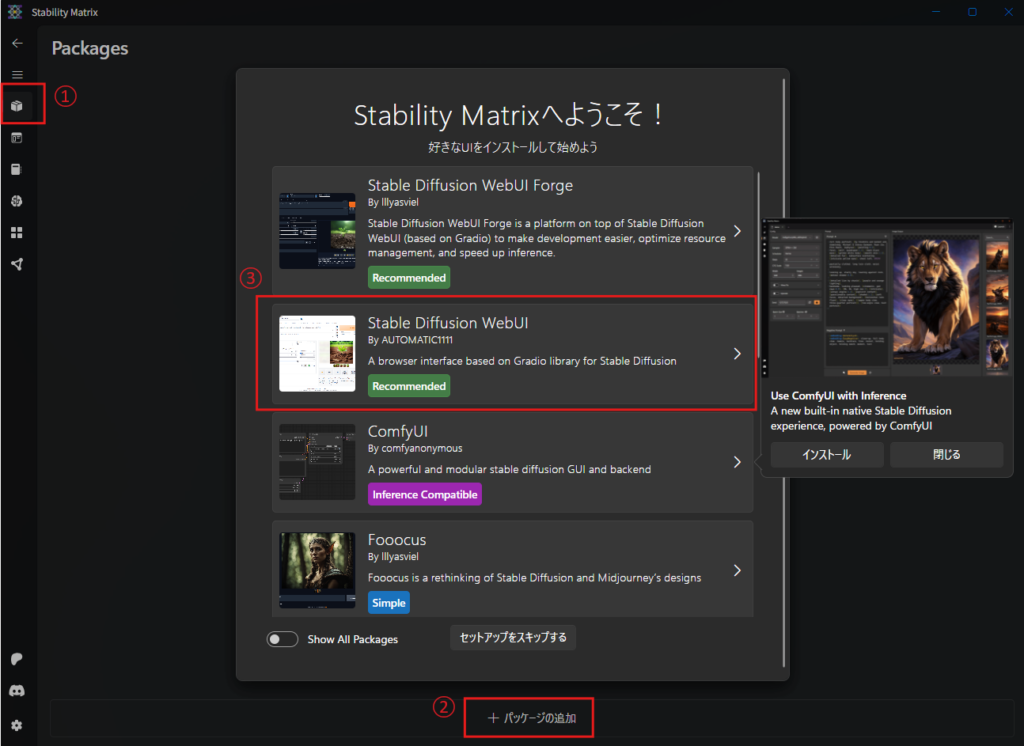

●パッケージ(Stable Diffusion WebUI By AUTOMATIC1111)を導入する

①Packageを選択する

②パッケージの追加をクリックする

③Stable Diffusion WebUI By AUTOMATIC1111を選択する

※同じ手順でStable Diffusion WebUI Forge等の他のパッケージをインストールすることもできます

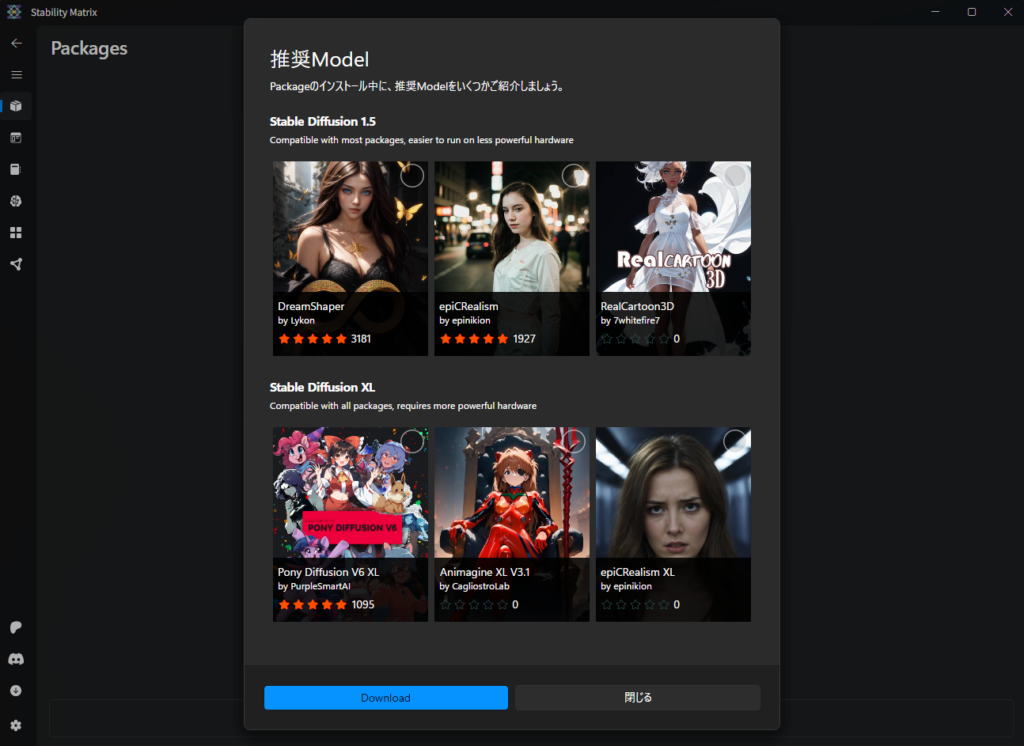

●推奨モデルの紹介画面を閉じる

私が使用しているモデル(Beautiful Realistic Asians)は表示されないと思いますので ”閉じる” をクリックします。

モデルに応じてアニメ系や実写系、実写系の中でも欧米系の顔立ちやアジア系の顔立ちなど生成される画像のスタイルが大きく変わってきます。モデルのインストールに関しては別途説明します。

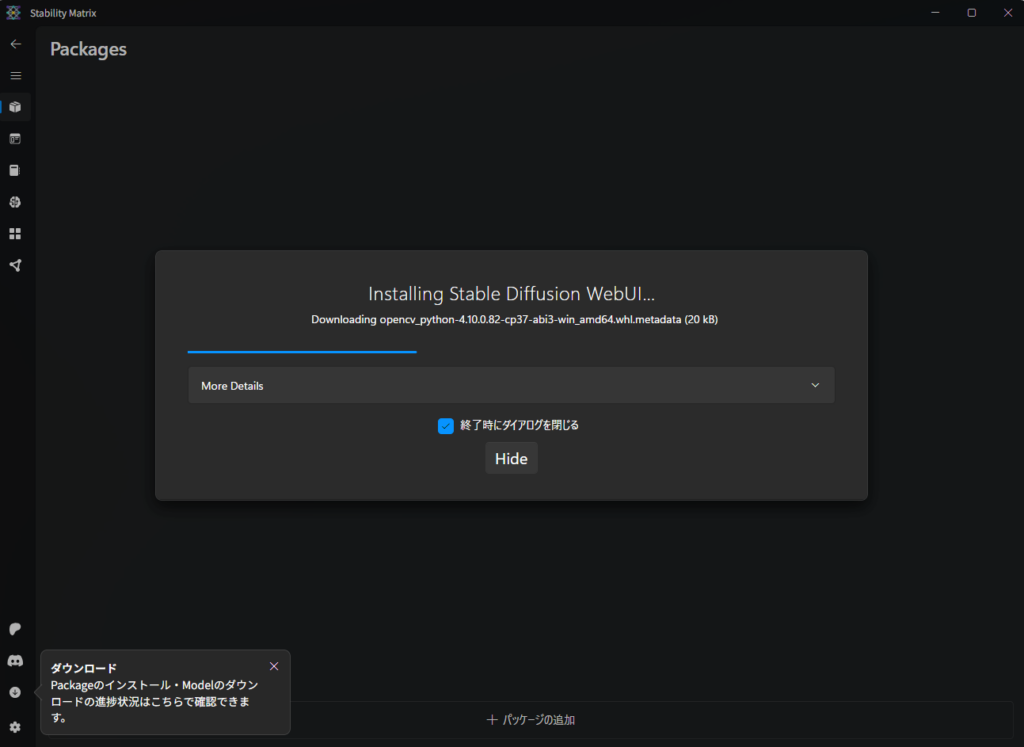

●パッケージ(Stable Diffusion WebUI By AUTOMATIC1111)がインストールされるまでしばらく待つ

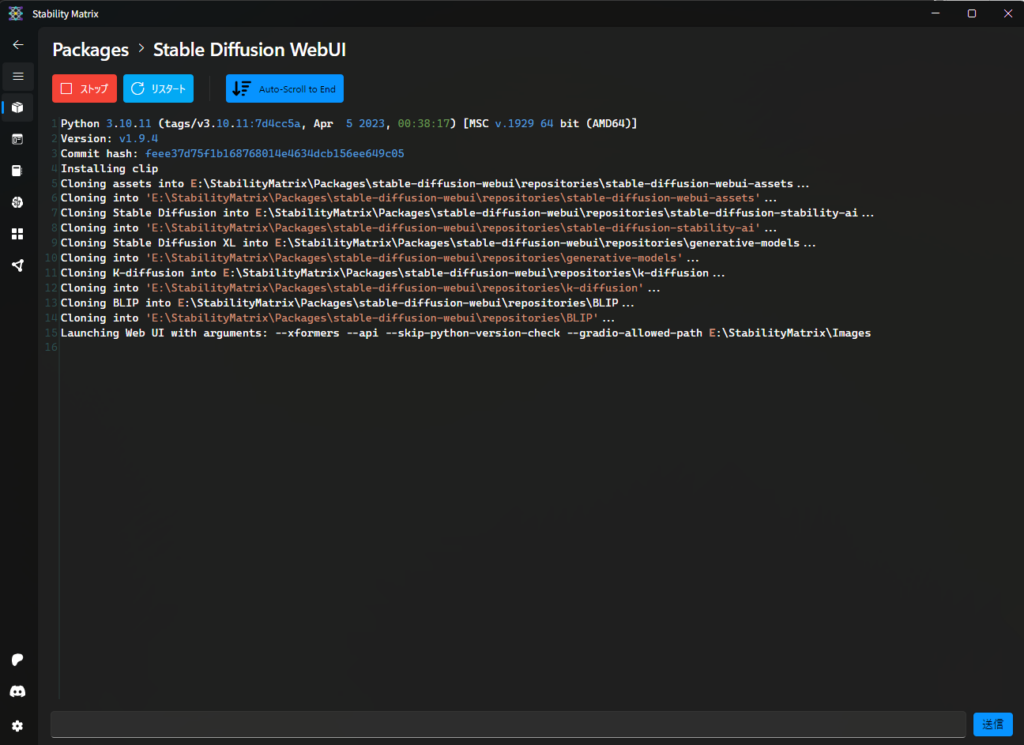

●LunchをクリックしてStable Diffusion WebUIを起動する

初回は起動に時間がかかりますが気長に待ちましょう。

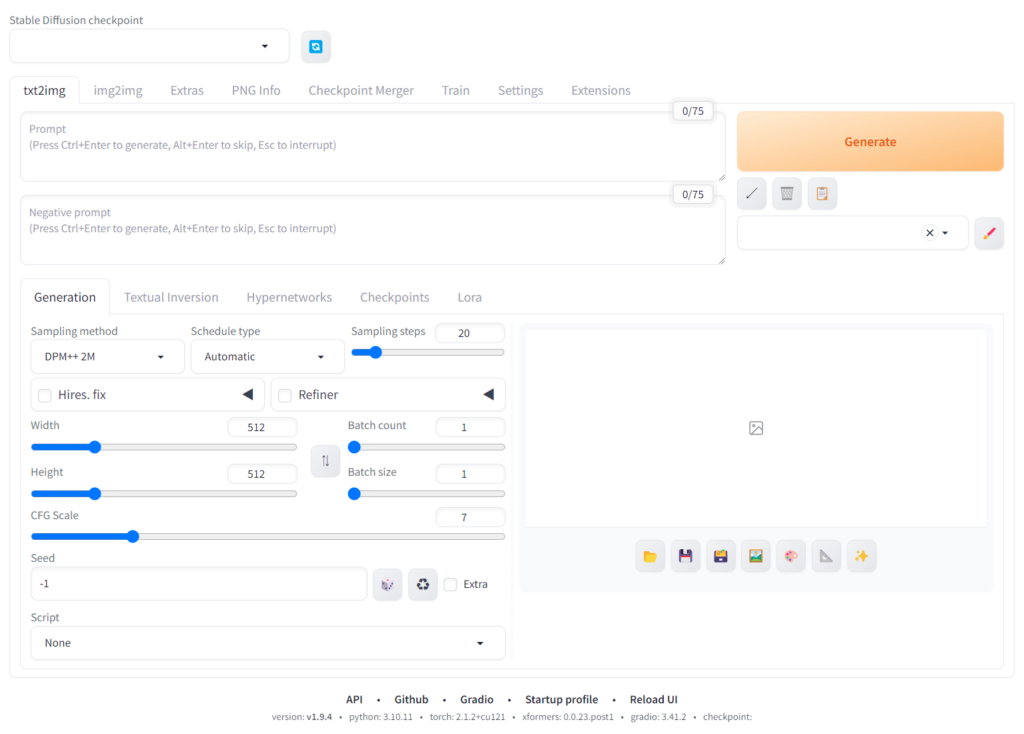

●しばらく待つとブラウザでStable Diffusion WebUIが起動する

以上でStable Diffusion WebUIのインストールは完了です!続いて環境構築について説明していきます。

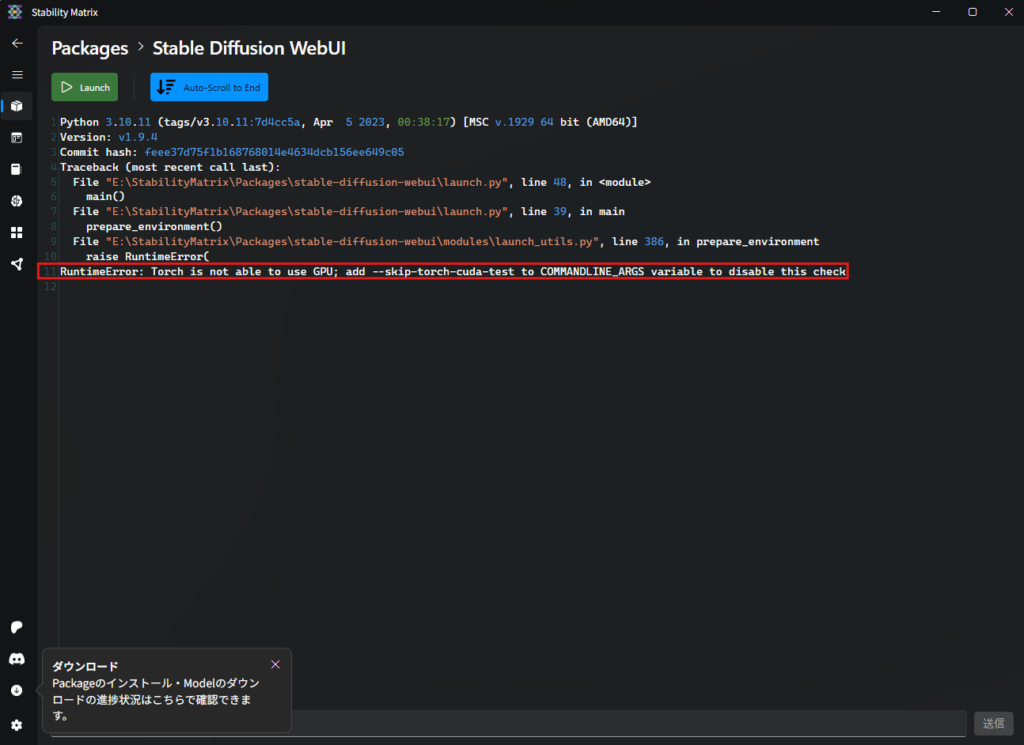

●トラブルシューティング

環境構築に進む前にインストール時のエラー対処について説明します。前項でLunchをクリックしてもブラウザでStable Diffusion WebUIが起動しない場合は何かしらのエラーが発生していると予想されます。よくあるエラーとして下図のようにGPU起因のRuntimeErrorがあります。(私も1年以上ドライバ更新をさぼっていたら下図のエラーになりました)

下図のエラーが表示された場合、GPU(NVIDIAグラフィックカード)のドライバを最新のものに更新することで対処することができます。GeForce Experienceを下記リンク先からダウンロードしてドライバを更新して下さい。

https://www.nvidia.com/ja-jp/geforce/geforce-experience/download

「Stable Diffusion」の環境構築

ここから私と同水準のAI美女を生成するための環境構築について説明していきます。

手順は大きく2つです。

①モデル(CheckpointとVAE)のインストール

②拡張機能のインストール

まずは①モデルのインストールについて説明をします。

モデルのインストール

使用するモデルに応じてアニメ系や実写系、実写系の中でも欧米系の顔立ちやアジア系の顔立ちなど生成される画像のスタイルが大きく変わってきます。今回は私が使用している”Beautiful Realistic Asians” という実写系モデル(checkpoint)の導入をしていきます。このモデルを使用することで日系や韓国系の美女を生成することができるようになります。また、画像品質の調整を行うモデル(VAE)の導入についても説明します。

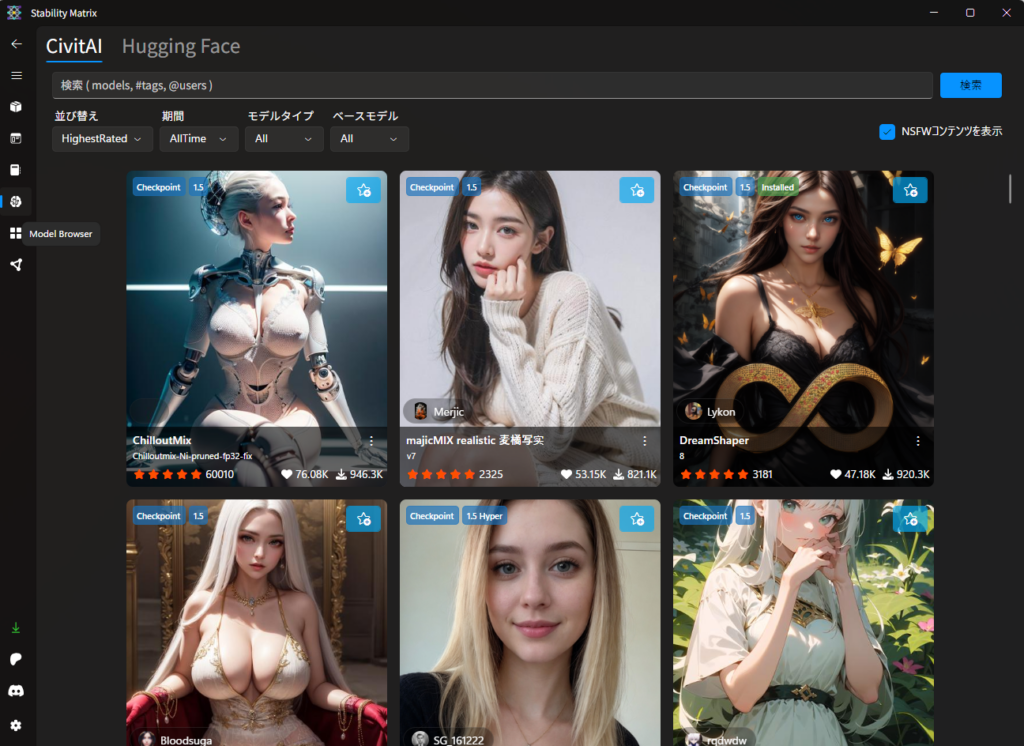

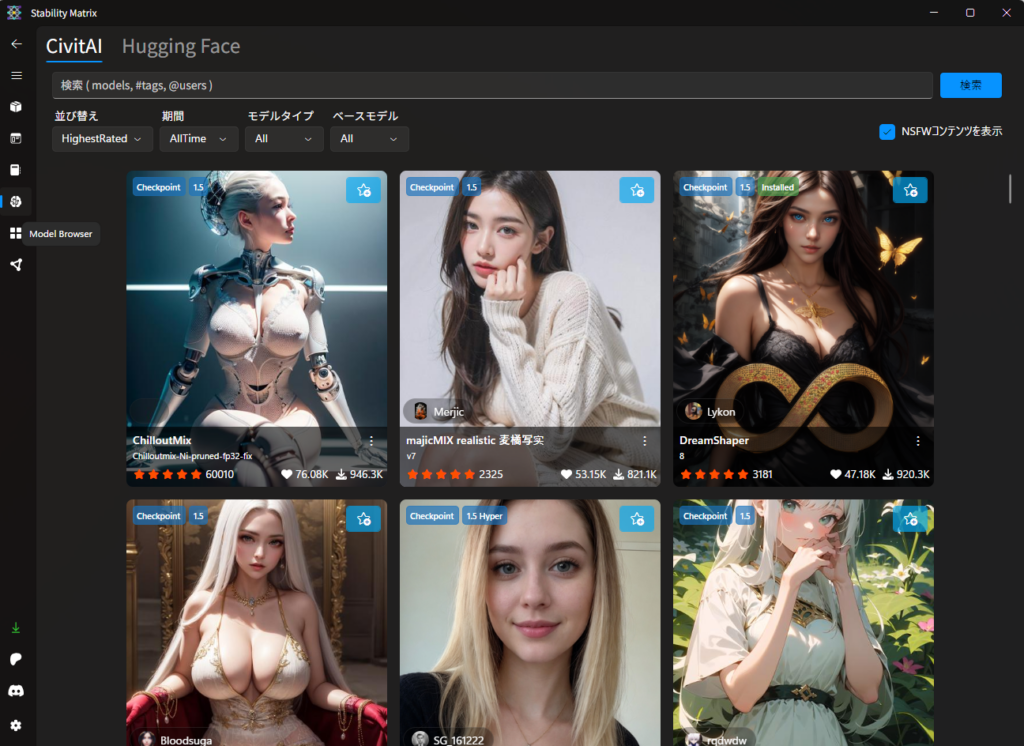

●Stability Matrix左側のタブからモデルブラウザを開く

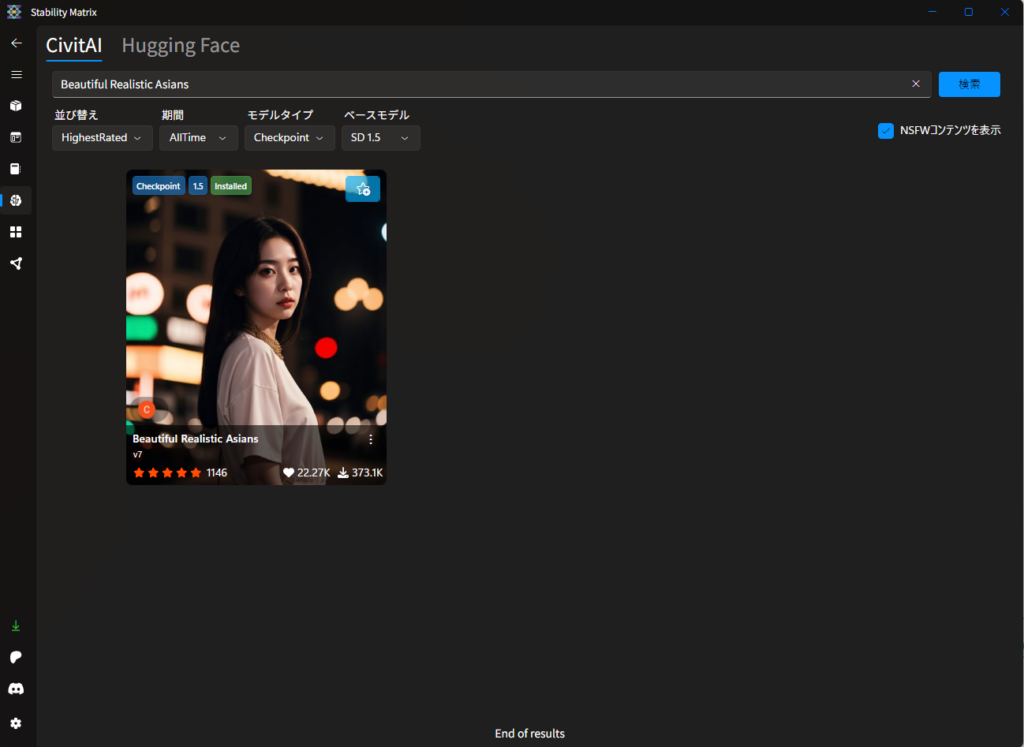

●CivitAIタブの検索欄から”Beautiful Realistic Asians”を検索する

このとき、期間:ALLTime モデルタイプ:Checkpoint ベースモデル:SD1.5 NSFWコンテンツを表示:✔を入れる を選択しておくと検索が楽になります。

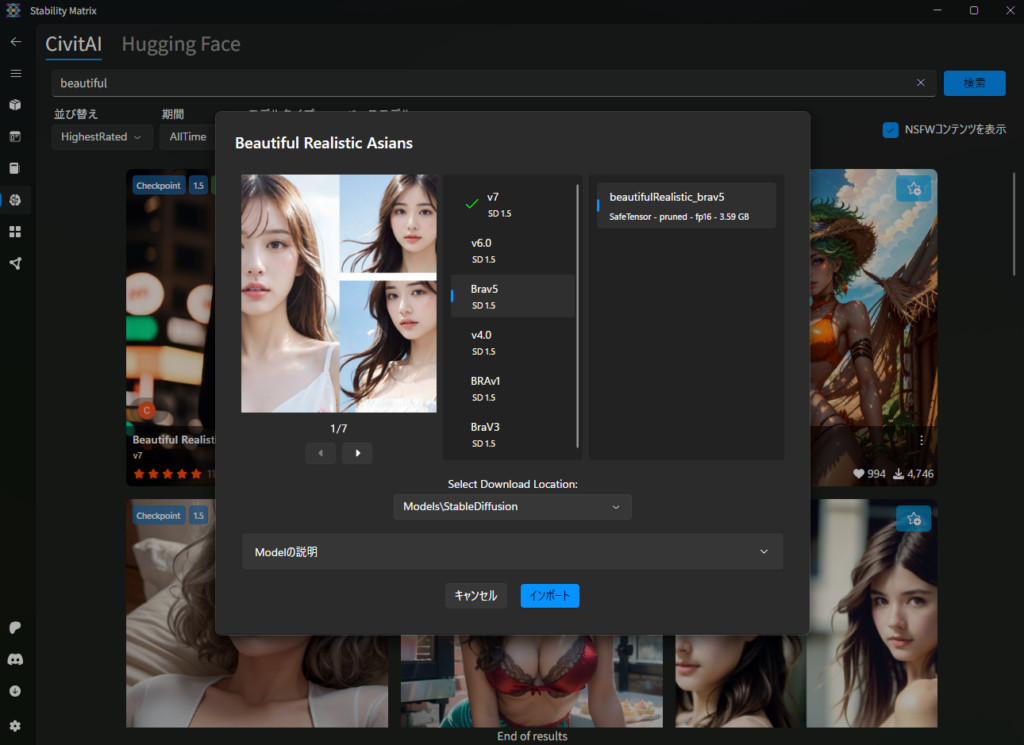

●バージョンを選択してインポートする

最新バージョンをインストールするなら”V7” 私と全く同じ環境にするなら”Brav5” を選択してインストールします。両方インストールしてどちらが好みで使いやすいか試してみても良いかもしれません。インポートが完了したらCheckpointの導入は完了です。次にVAEの導入について説明をしていきます。

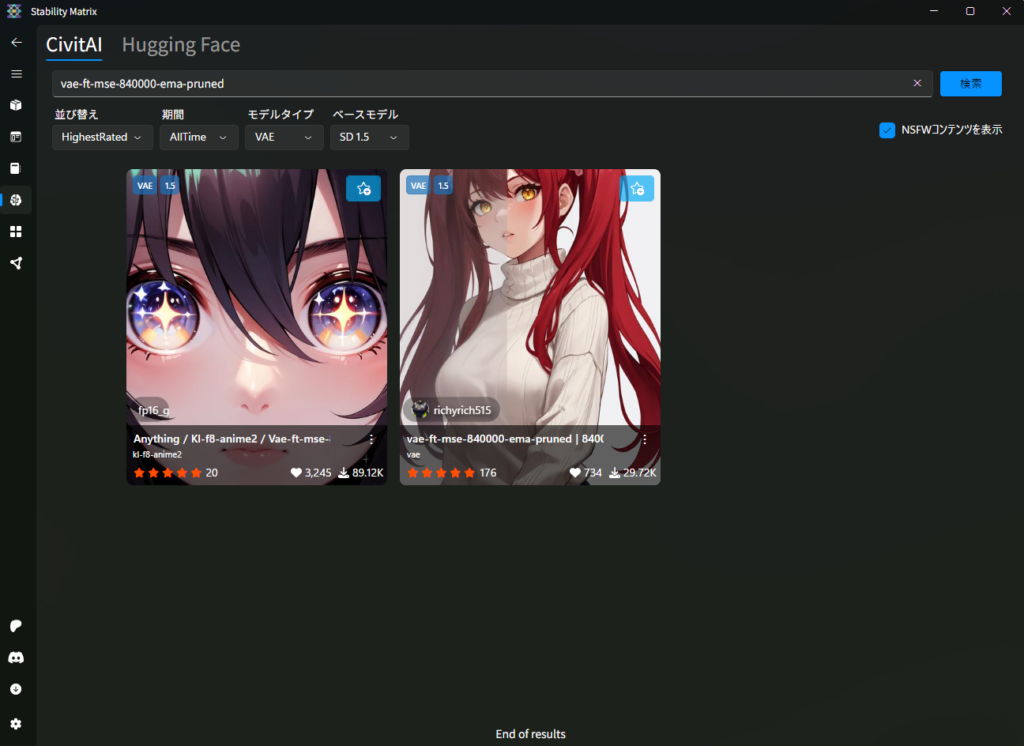

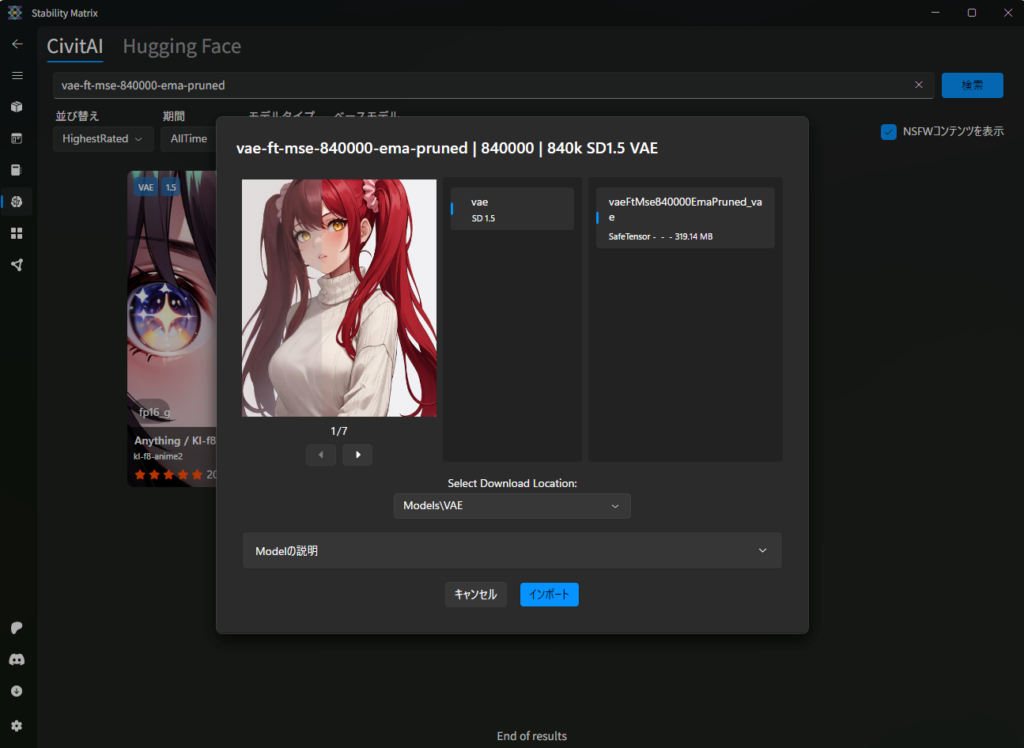

●CivitAIタブの検索欄から”vae-ft-mse-840000-ema-pruned”を検索する

このとき、モデルタイプ:VAE にして検索することをお忘れなく! モデルタイプ:Checkpoint のままだと検索結果に表示されません。

●インポートボタンをクリックしてVAEをインポートする

以上でVAEのインポートが完了します。

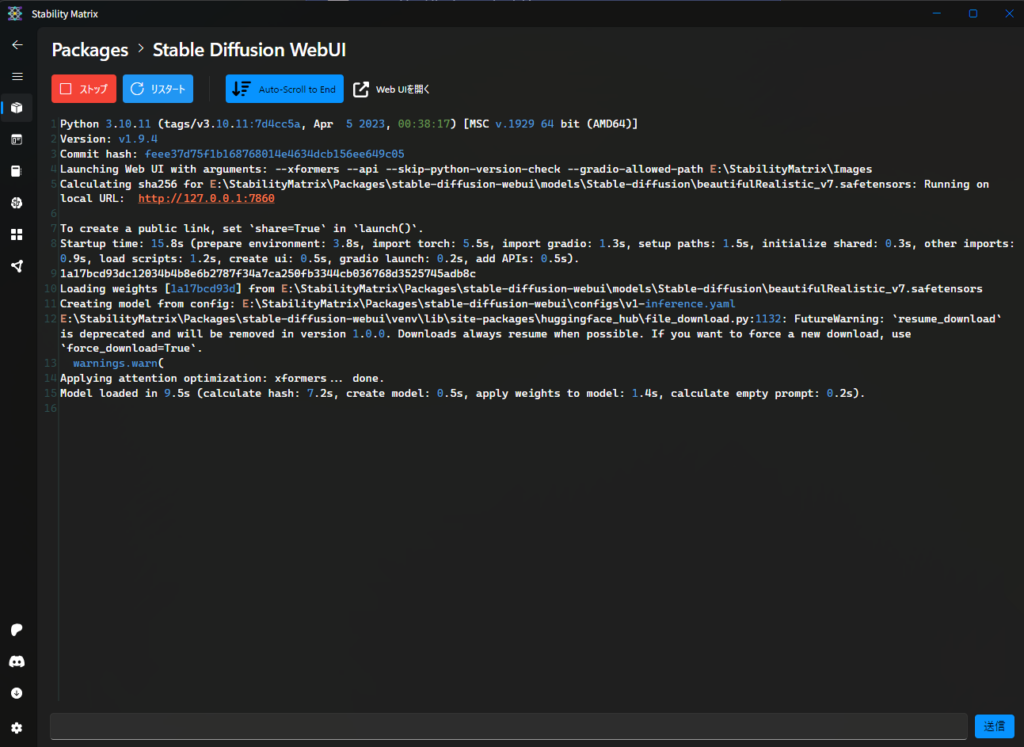

●Stability Matrix左側のPackagesタブを開き、リスタートをクリックする

インストールしたモデルをWebUIに反映させるために再起動させます。

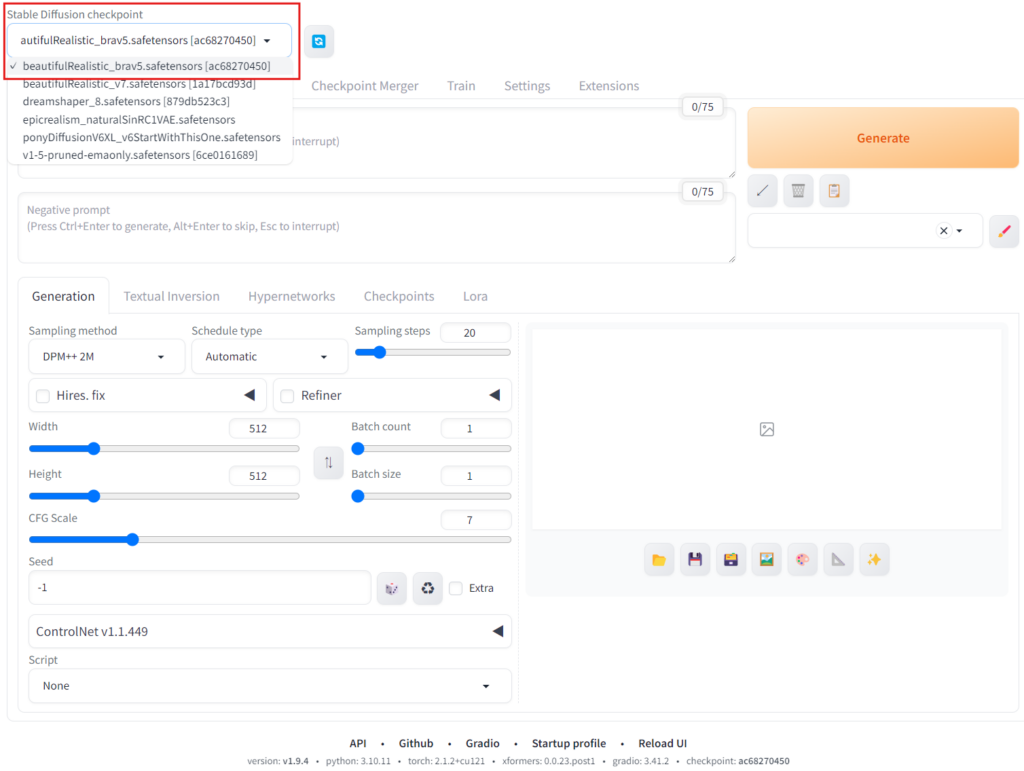

●モデル(Checkpoint)が反映されているか確認する

WebUI左上の”Stable Diffusion checkpoint” 欄に先ほどインストールした”Beautiful Realistic”が表示されていれば反映完了です!

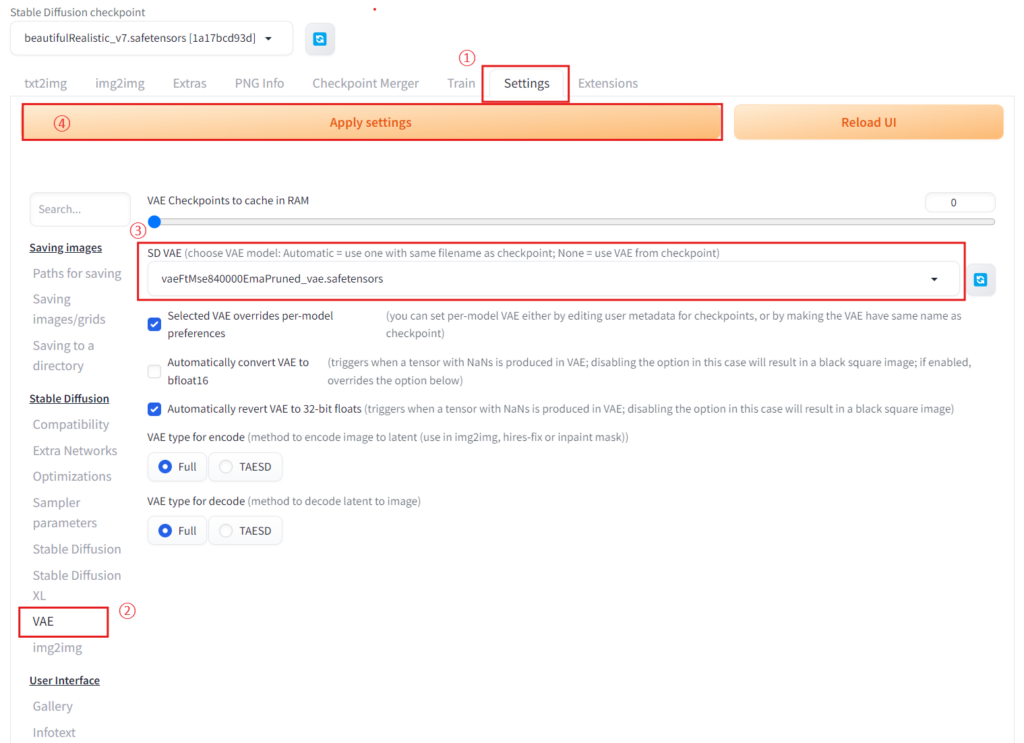

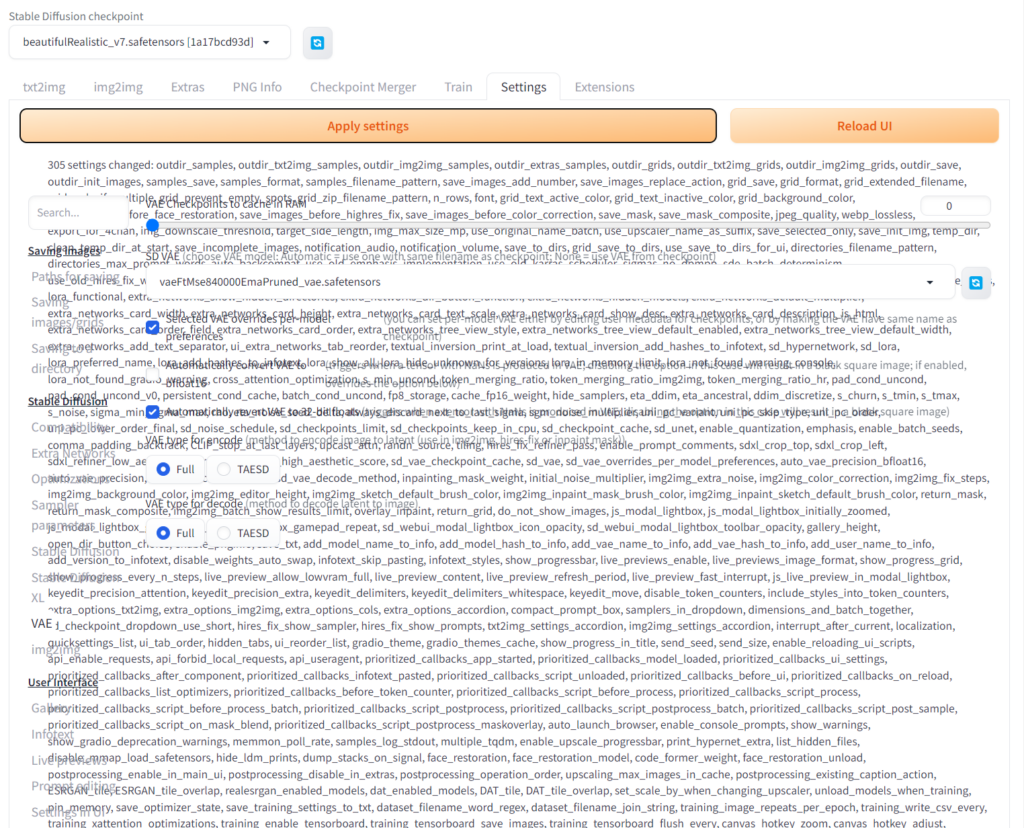

●モデル(VAE)を反映させる

①WebUIの”Setting”タブを開く

②VAEを選択する

③SD VAE欄を先ほどインストールした”vaeftmse840000emapruned” に変更する

④Apply settings をクリックしてVAEを反映させる

以上でモデルの反映は完了です!VAEを反映させると下図のようにバグった画面になることがありますが気にしなくてOKです。

●【補足】CivitAIから直接モデルをダウンロードする方法

ここまでStability Matrixからモデルをインストール、反映させる方法を説明してきましたが、CivitAIのサイトから直接モデルをダウンロードする方法もあります。トラブル発生時にフォルダ構成を理解しておくと便利なので簡単に説明しておきます。

下記リンク先(CivitAIのサイト)からモデルをダウンロード可能です。

https://civitai.com/

ダウンロードしたモデルを下記フォルダに入れるとWebUIに反映させることができます。

Checkpointのフォルダのパス: Stability Matrixをインストールした任意のフォルダ\Models\StableDiffusion

VAEのフォルダのパス : Stability Matrixをインストールした任意のフォルダ\Models\VAE

※私の場合任意のフォルダは E:\StabilityMatrixです。

拡張機能のインストール

「Stable Diffusion」では様々な拡張機能があります。その中でも必須ともいえる”ControlNets”という拡張機能の導入について説明します。”ControlNets”を活用することでプロンプトだけでは難しい細かいコントロールができるようになります。例えば、生成するキャラクターに特定のポーズを取らせたり参考画像に近い表現させたりすることが容易になります。

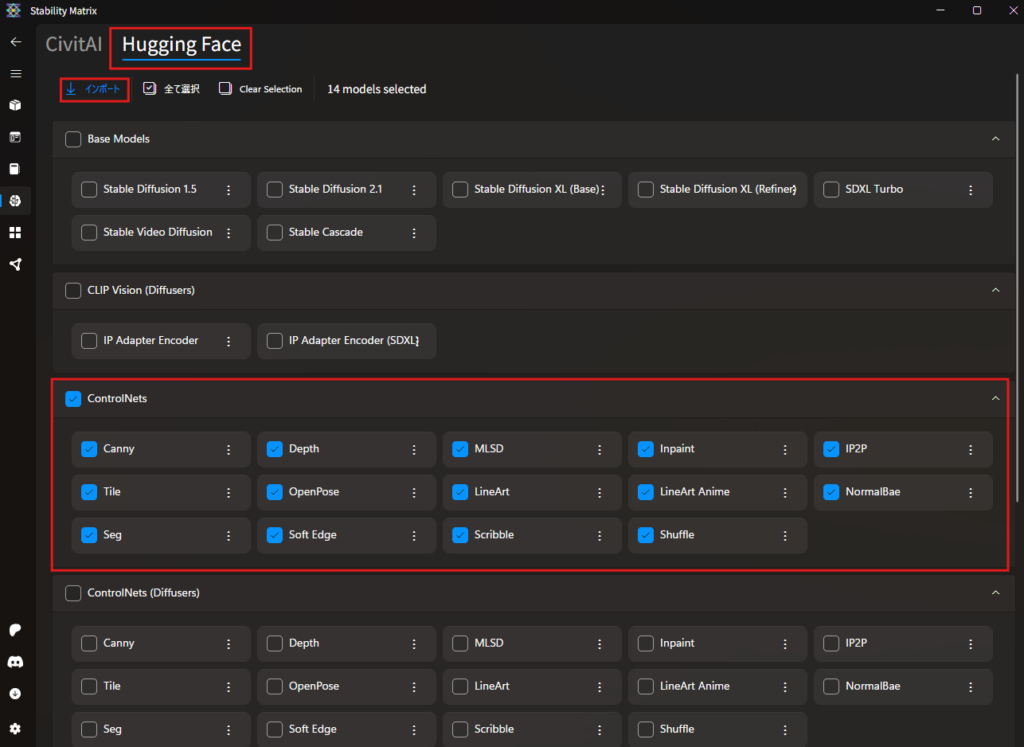

●Stability Matrix左側のタブからモデルブラウザを開く

●Hugging Faceのタブを開き”ControlNets”を選択してインポートする

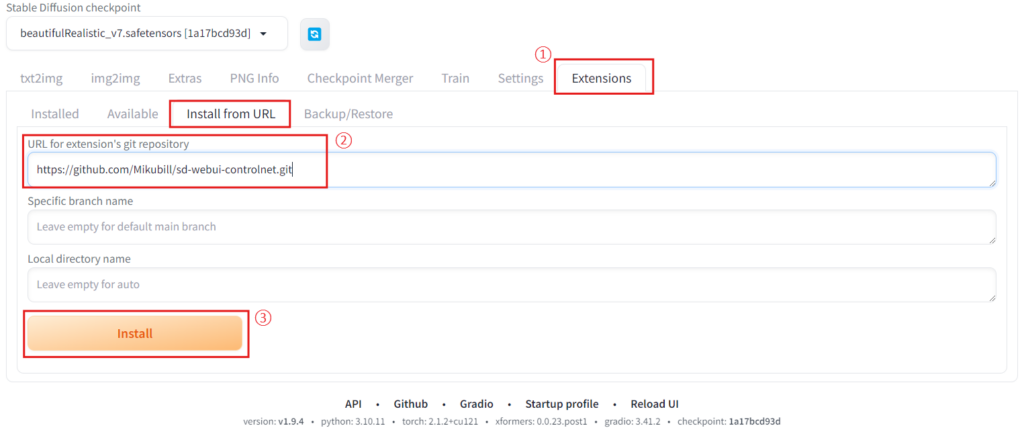

●WebUIに”ControlNets”をインストール、適用する

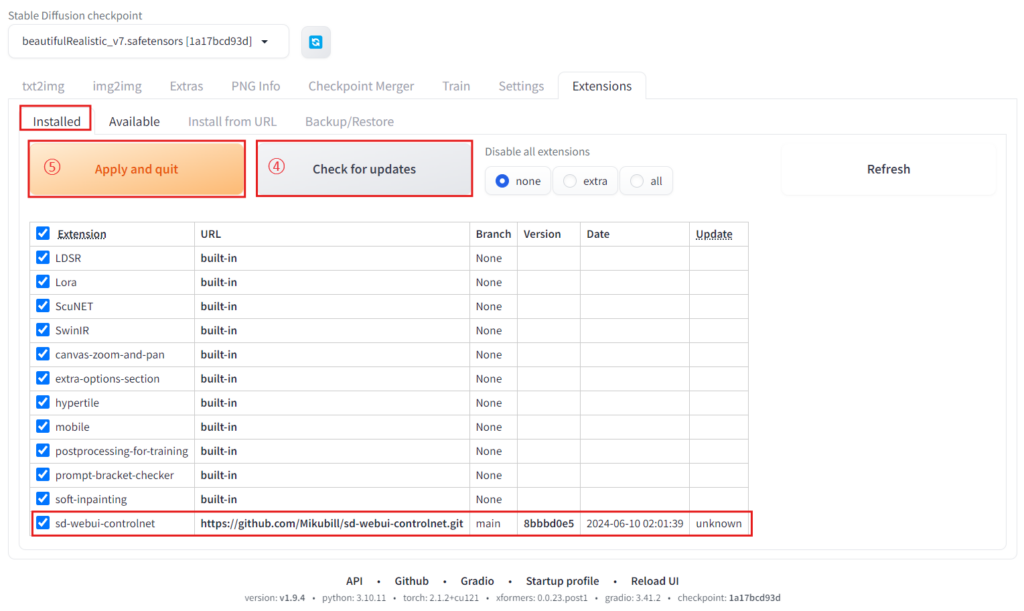

①WebUIの”Extensions”タブを開く

②”Install from URL”タブのURL for extensions git repository 欄に書きURLを入力(コピー&ペースト)する

https://github.com/Mikubill/sd-webui-controlnet.git

③Install をクリックする

④”Installed”タブの”Check for updates” をクリックしてコントロールネットを最新版にアップデートする

⑤”Apply and quit”をクリックして適用する

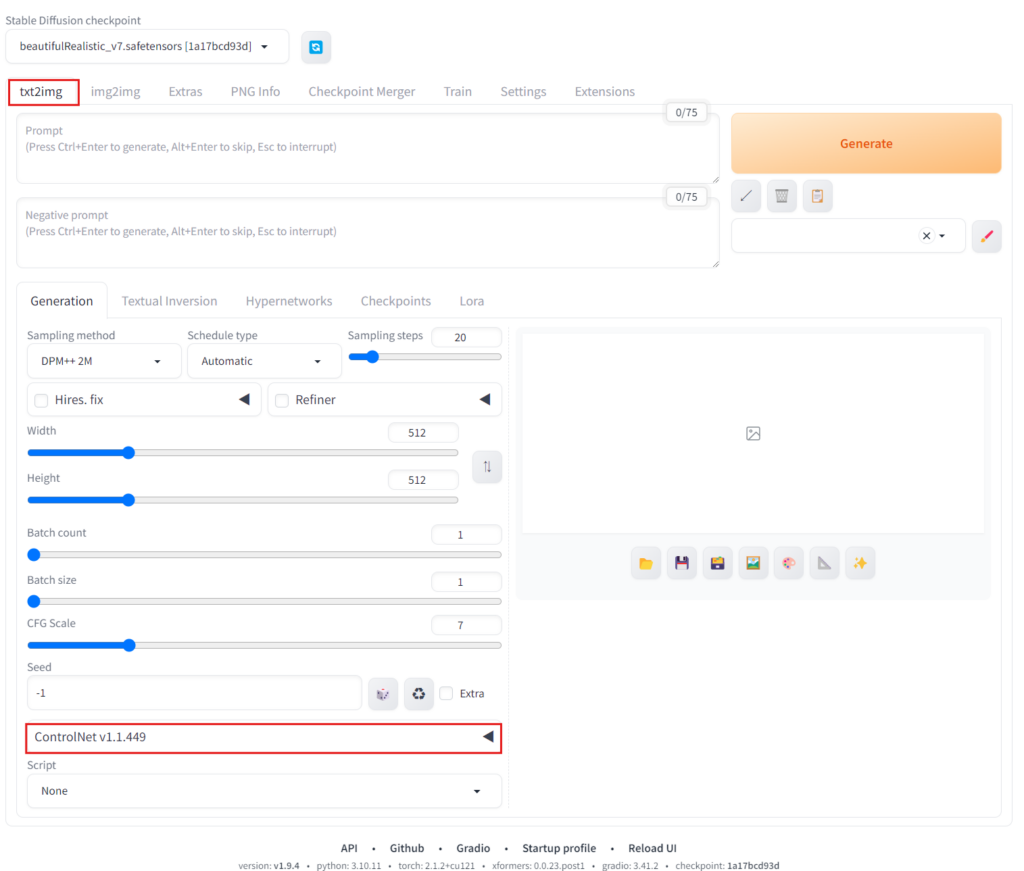

⑥”txt2img”タブを開き”ControlNet”が表示されていれば適用完了!

以上でローカルPCでの環境構築は完了です!おつかれさまでした!”4章AI美女の生成”で実際にAI美女を生成してみましょう。

Google Colab版 導入と環境構築

Google Colabでの環境構築について説明していきます。

※ローカルPC「Stable Diffusion」を導入済みの方は本章は飛ばして”4章AI美女の生成”に進んで下さい。

Google Colab(Google Colaboratory)とはGoogleが提供するクラウドサービスです。Googleが持つ大規模なデータセンターの計算リソース(CPUやGPU)を安価に使用できます。これを活用することでお持ちのPCのスペックに影響されずに「Stable Diffusion」を使用できるようになります。

「Stable Diffusion」の導入

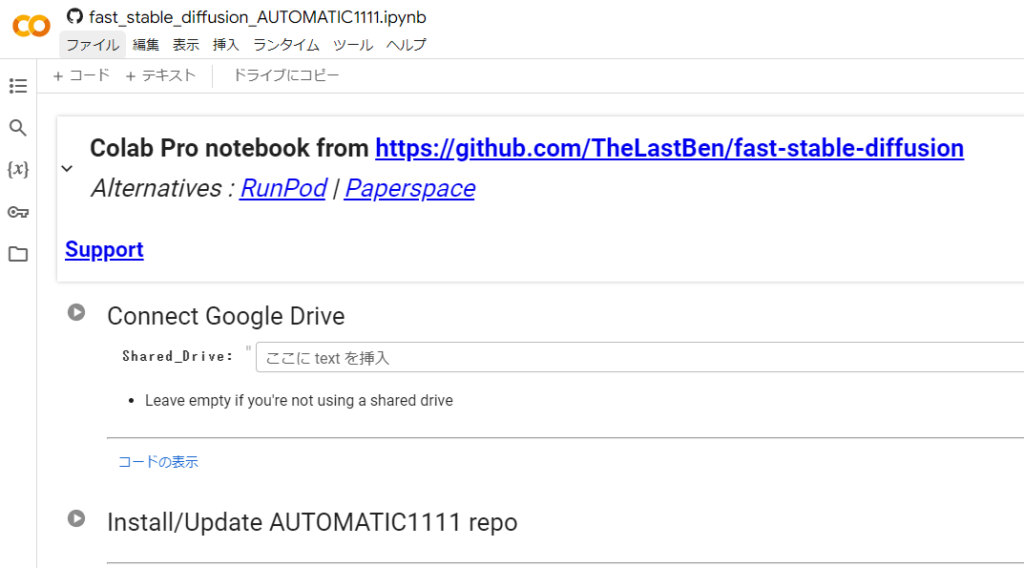

●下記リンク先(Google Colab)へアクセスする

お持ちのGoogleアカウントにログインした状態でGoogle Colabへアクセスして下さい。

●ファイルタブの ”ドライブにコピーを保存” をクリックする

これによりお持ちのGoogleアカウントのGoogleドライブにノートブックがコピーされます。

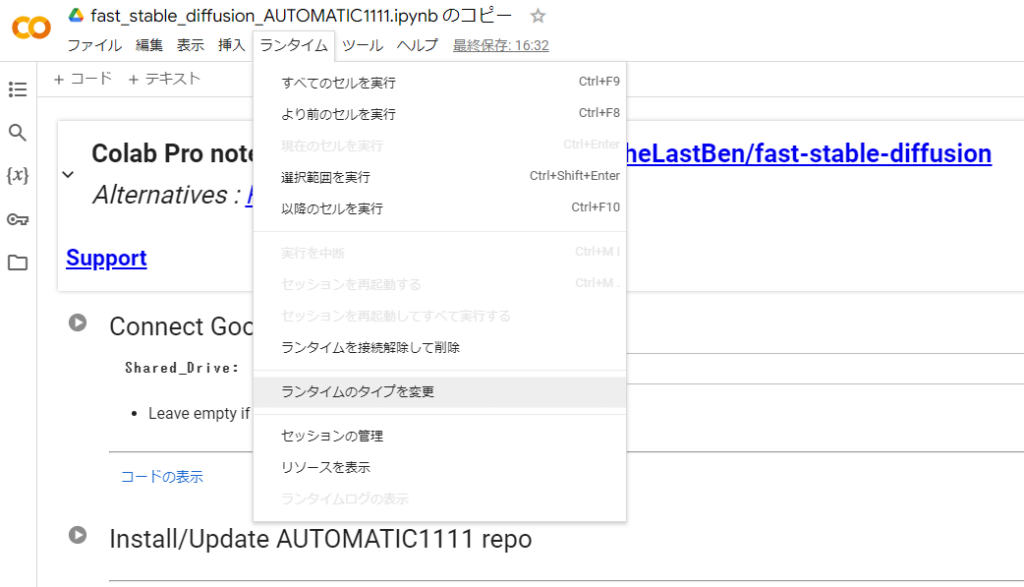

●ランタイムの設定を最適化する

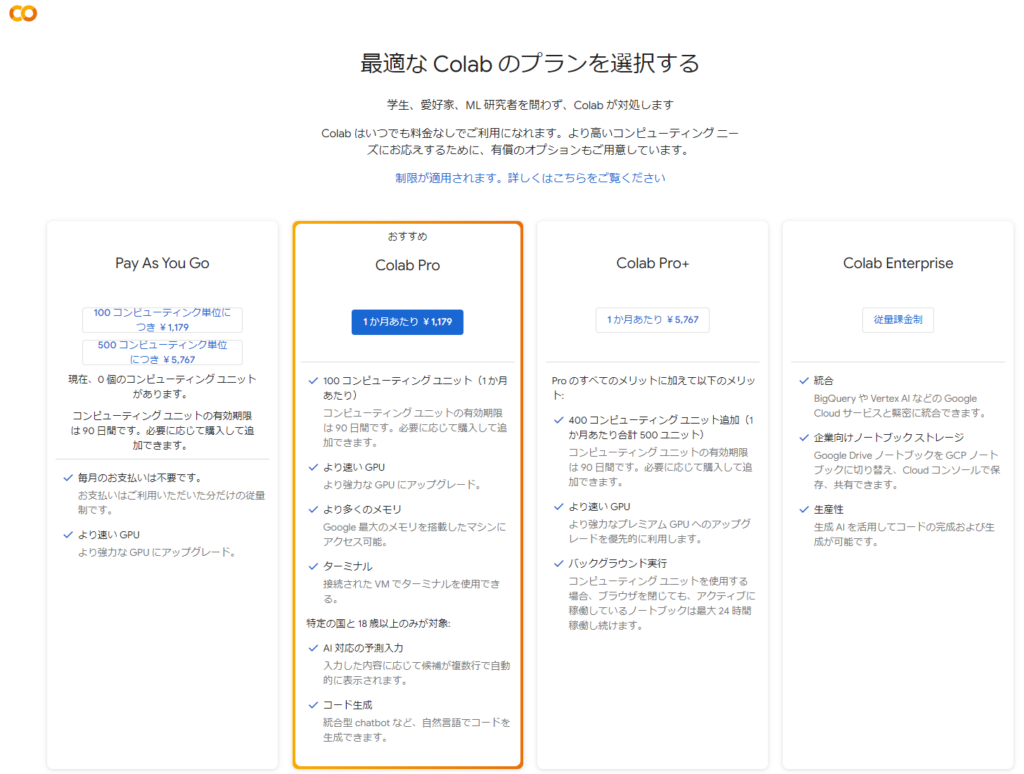

「Stable Diffusion」は無料版Google Colabでは使用することができません。下記の手順でColab Pro(1ヵ月あたり1,179円)にアップグレードして、ランタイムの設定を最適化します。

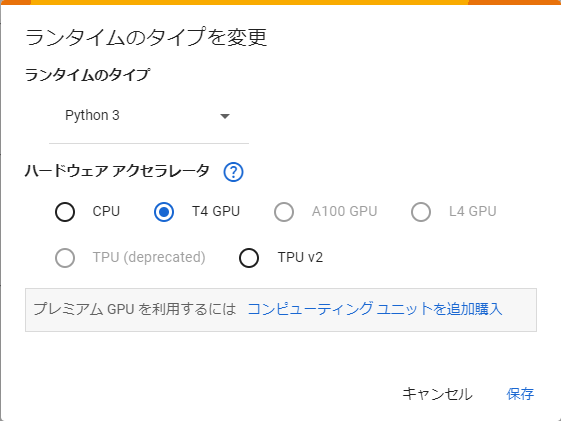

①ランタイムタブの ”ランタイムのタイプを変更” をクリックする

②コンピューティングユニットを追加購入をクリックする

③Colab Pro(1ヵ月あたり1,179円)にアップグレードする

④ランタイムのタイプを確認する

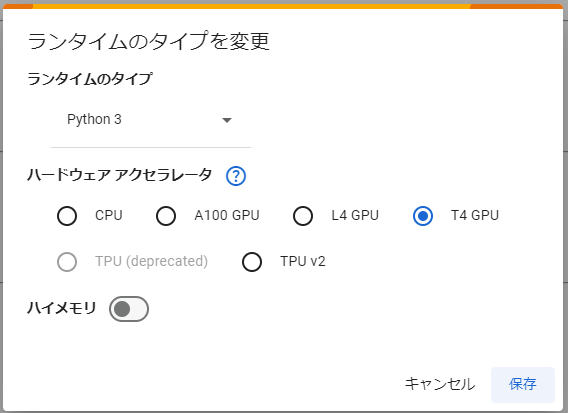

Colab Proの契約が完了すると無料版では選択できなかったランタイムを選択できるようになります。

有料プランの初期設定である、ランタイムのタイプ:Python3 ハードウェア アクセラレータ:T4 GPU が選択されていることを確認してキャンセル(設定を変更した場合は保存)をクリックします。

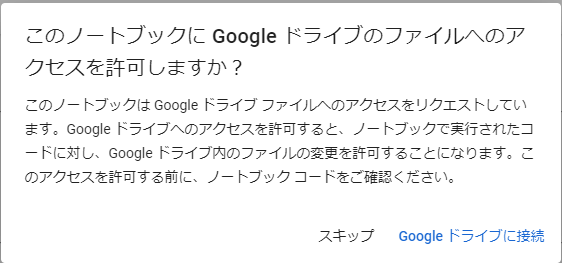

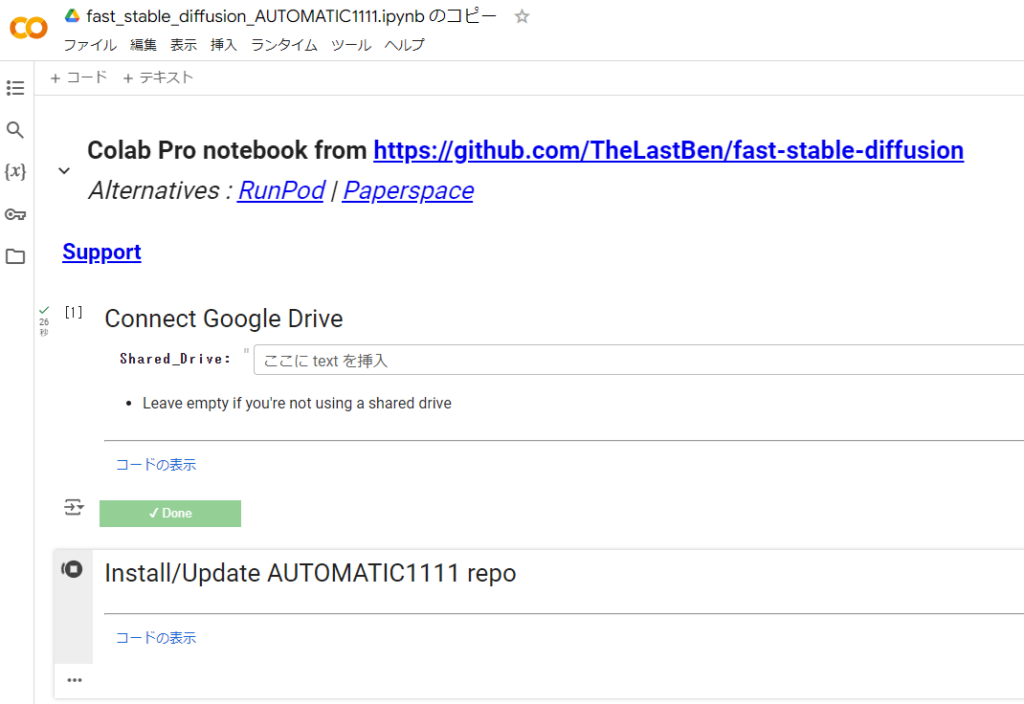

●Connect Google Driveの▶ボタンをクリックする

これによりGoogle ColabからGoogleドライブに接続できるようになります。”✔Done”が表示されれば完了です。

※アクセス許可の確認画面が表示された場合は”Googleドライブに接続”をクリックして接続して下さい

●Install/Update AUTOMATIC1111 repoの▶ボタンをクリックする

これによりAUTOMATIC1111をインストールすることができます。しばらく待ち”✔Done”が表示されれば完了です。

●Requirementsの▶ボタンをクリックする

これにより「Stable Diffusion」を動かすためのPythonパッケージがインストールされます。しばらく待ち”✔Done”が表示されれば完了です。

ここまでで「Stable Diffusion」を起動するための準備が整いました。次に「Stable Diffusion」でAI美女を生成するための環境構築について説明をしていきます。

「Stable Diffusion」の環境構築

ここから私と同水準のAI美女を生成するための環境構築について説明していきます。

手順は大きく2つです。

①モデル(Checkpoint)のインストール

②拡張機能のインストール

まずは①モデルのインストールについて説明をします

モデルのインストール

使用するモデルに応じてアニメ系や実写系、実写系の中でも欧米系の顔立ちやアジア系の顔立ちなど生成される画像のスタイルが大きく変わってきます。今回は私が使用している”Beautiful Realistic Asians” という実写系モデル(checkpoint)の導入をしていきます。このモデルを使用することで日系や韓国系の美女を生成することができるようになります。

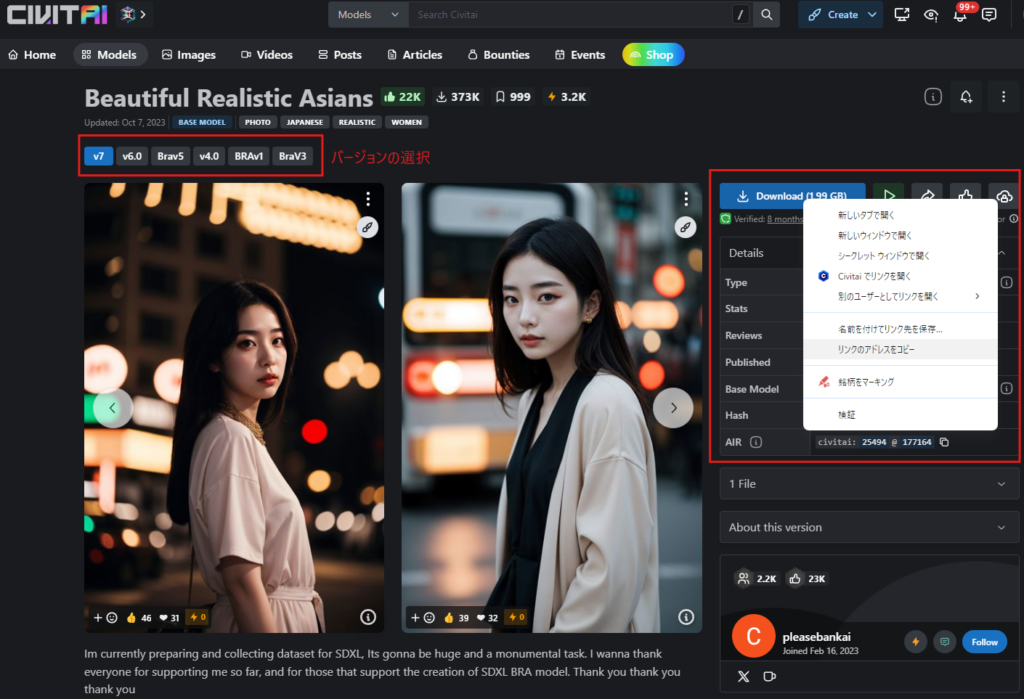

①下記リンク先をクリックしCivitAIサイトを開く

Beautiful Realistic Asians – v7 | Stable Diffusion Checkpoint | Civitai

Im currently preparing and collecting dataset for SDXL, Its gonna be huge and a monumental task. I wanna thank everyone for supporting me so far, a…

②”Download”ボタンを右クリックし”リンクのアドレスをコピー”する

※最新版はv7ですが私と全く同じ環境にしたい場合はBrav5を選択してください

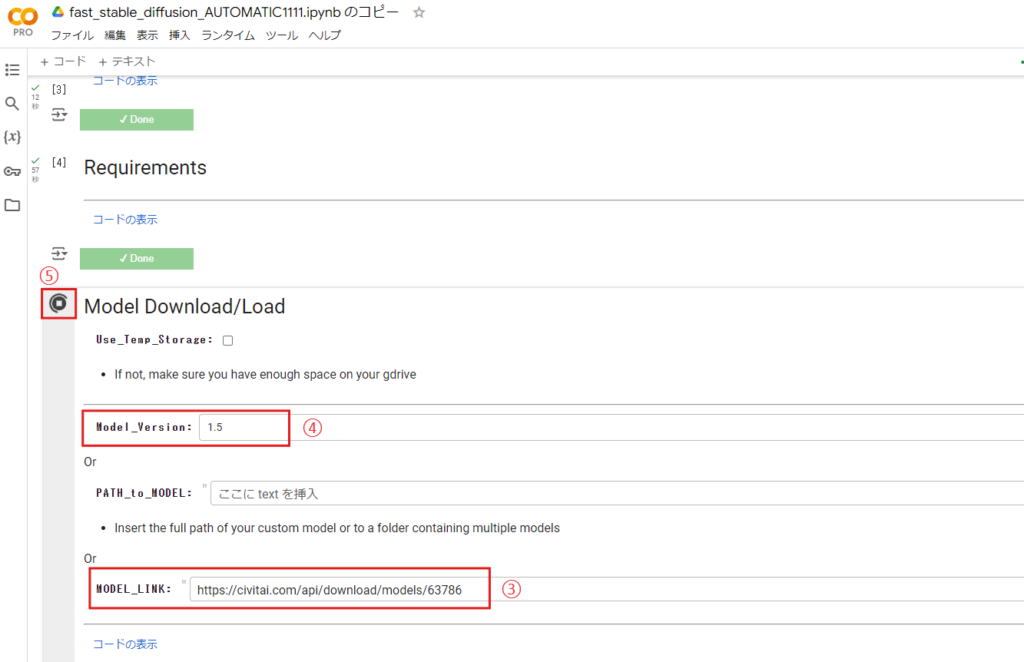

③Model Download/Load内のMODEL_LINK欄に先ほどコピーしたダウンロードリンクをペーストする

④Model Download/Load内のModl_Version欄をクリックし”1.5”を選択する

⑤Model Download/Loadの▶ボタンをクリックする

しばらく待ち”✔Done”が表示されればモデルのダウンロードは完了です。

拡張機能のインストール

「Stable Diffusion」では様々な拡張機能があります。その中でも必須ともいえる”ControlNets”という拡張機能の導入について説明します。”ControlNets”を活用することでプロンプトだけでは難しい細かいコントロールができるようになります。例えば、生成するキャラクターに特定のポーズを取らせたり参考画像に近い表現させたりすることが容易になります。

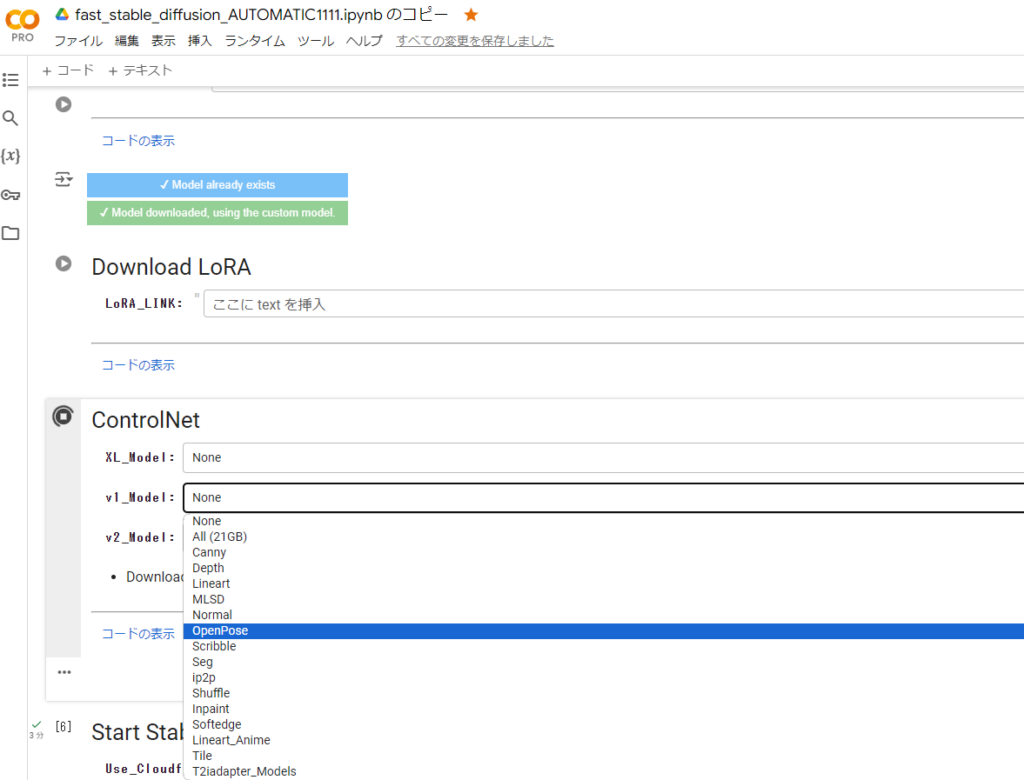

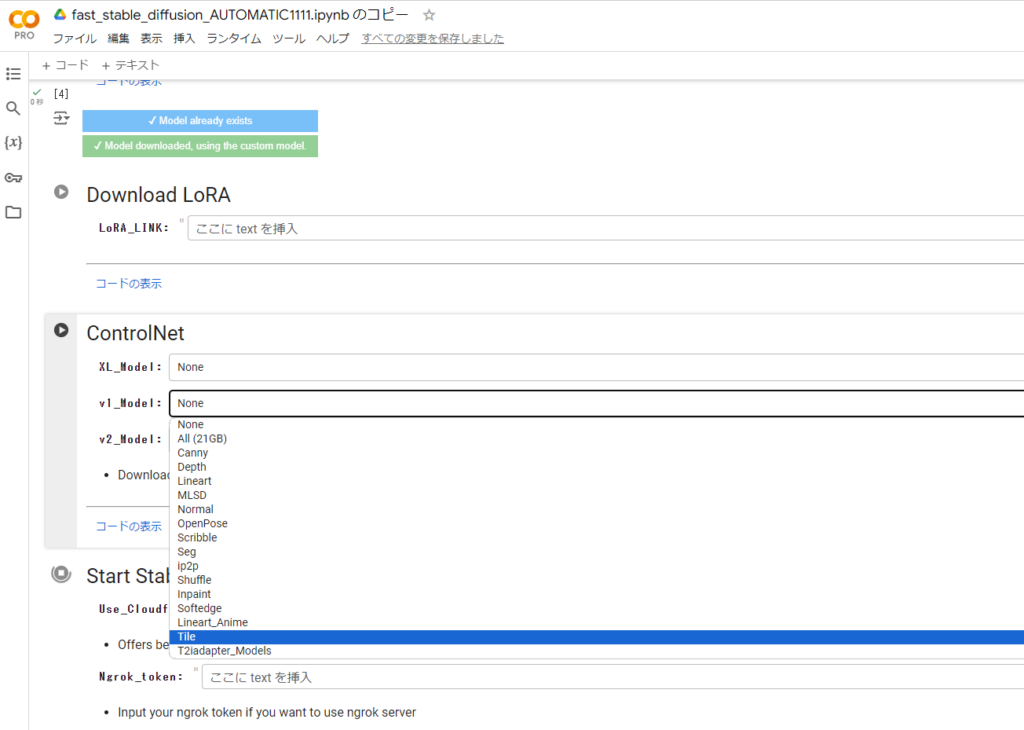

●ControlNet内のv1_Model欄をクリックし”OpenPose” を選択する

●Model Download/Loadの▶ボタンをクリックする

しばらく待ち”✔Done”が表示されれば”OpenPose” のダウンロードは完了です。

ControlNetのOpenPoseを使用することで特定のポーズを持つ人物画像を簡単に生成することができるようになります。

●先ほどと同様の手順でControlNet内のv1_Model欄をクリックし”Tile” を選択する

●Model Download/Loadの▶ボタンをクリックする

しばらく待ち”✔Done”が表示されれば”Tile” のダウンロードは完了です。

ControlNetのTileを使用することで生成済みの画像のディテールを保ちながら高解像度化することができるようになります。

以上で拡張機能のインストールは完了です。

※All(21GB)を選択してControlNetの全てのモデルをダウンロードすることも可能です。全てダウンロードしても最初は使いこなせないと思いますのでまずは”OpenPose” と”Tile”の2つをダウンロードすることを推奨します。

以上で環境構築は完了しましたので、実際に「Stable Diffusion」を起動してみます。

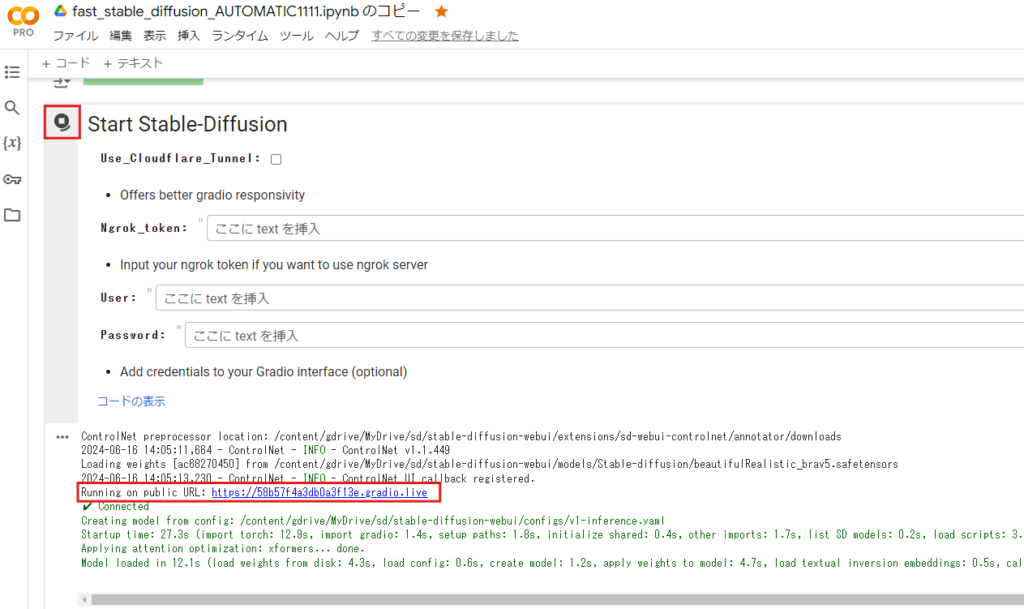

●Start Stable Diffusionの▶ボタンをクリックする

初めはしばらく時間がかかりますので気長に待ちましょう。

“Running on public URL”というリンクが表示されたらStart Stable Diffusionが起動した合図です。

●”Running on public URL”のリンクをクリックしてWebUIを起動する

リンクをクリックするとブラウザ上でStable Diffusion WebUIが起動します。

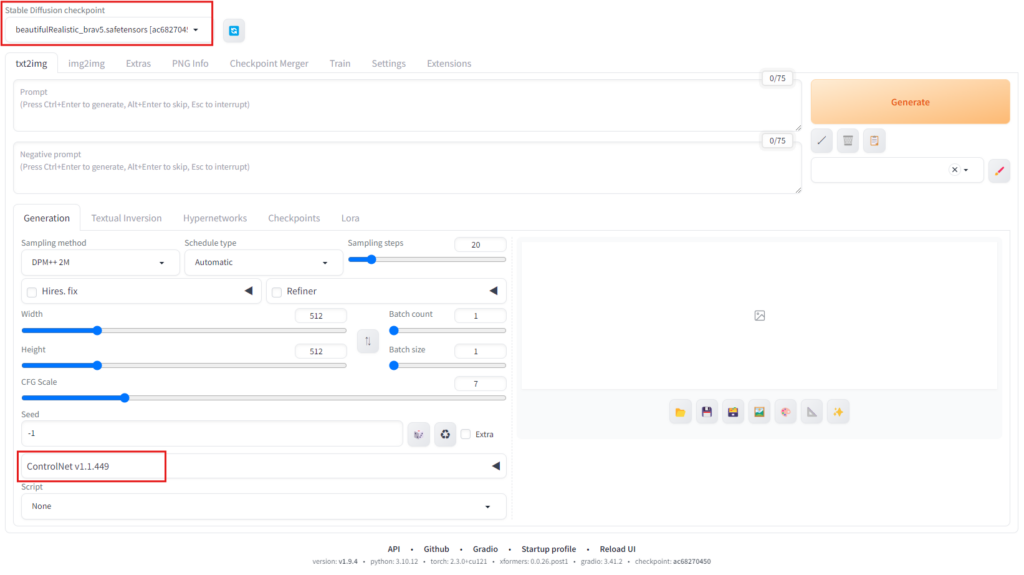

ここまでにインストールしたモデル”Beautiful Realistic”や”ControlNet”が表示されていることを確認しましょう。

以上でGoogle Colabでの環境構築は完了です!おつかれさまでした!”4章AI美女の生成”で実際にAI美女を生成してみましょう。

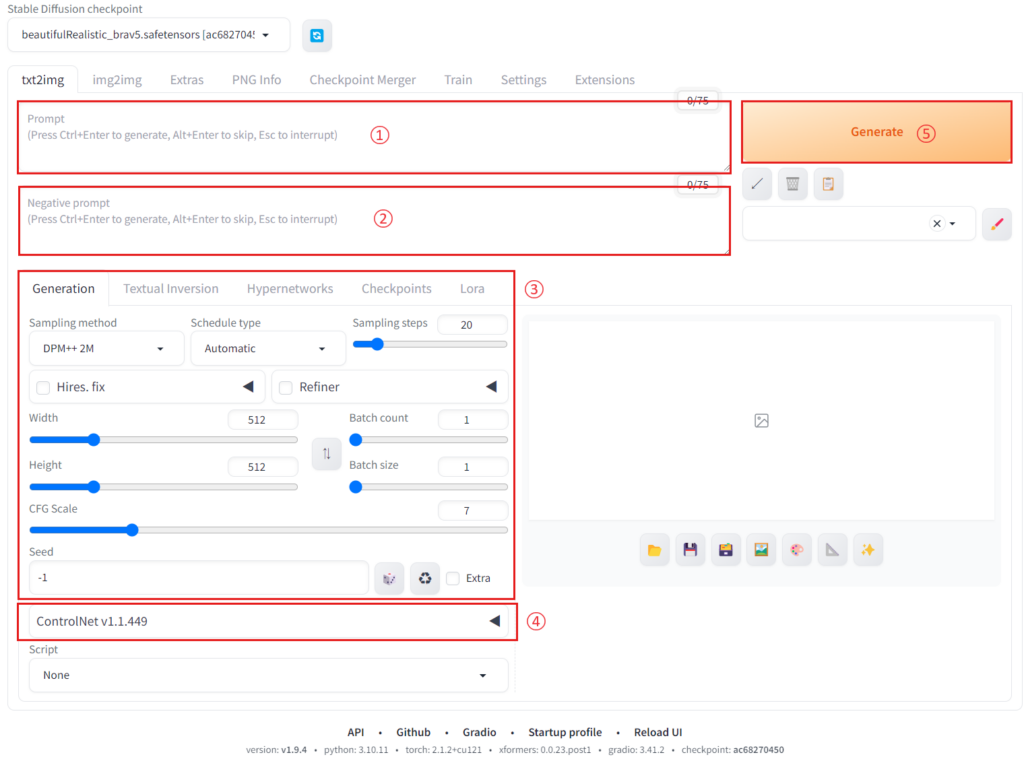

AI美女の生成

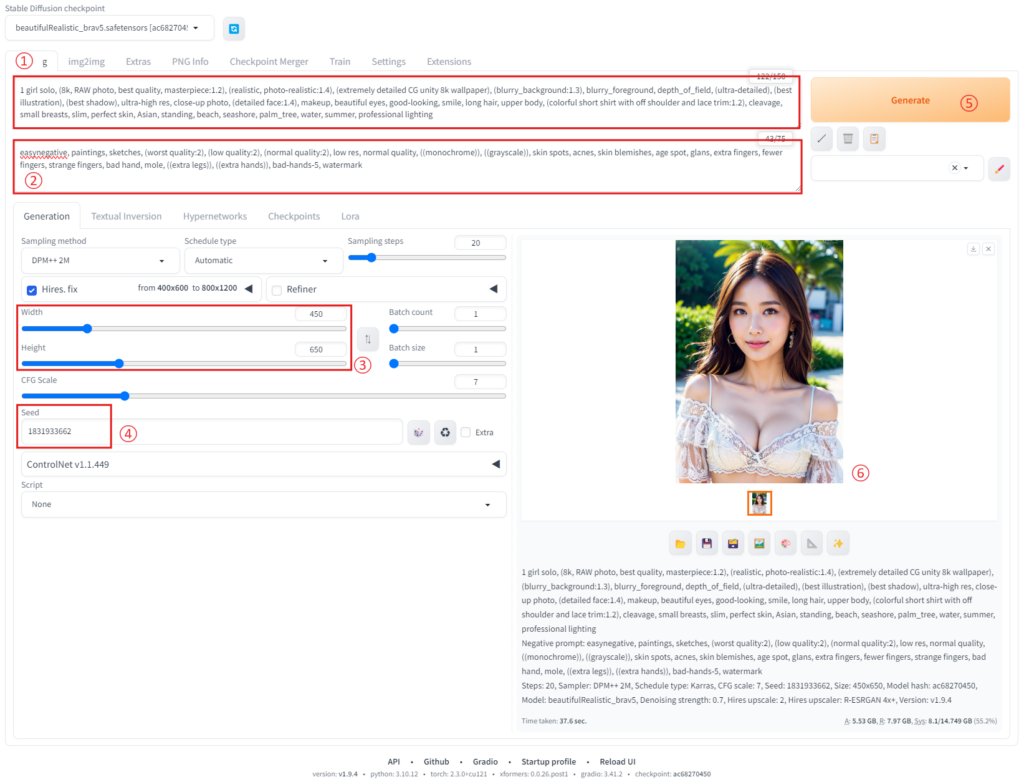

実際にAI美女を生成する手順を説明していきます。

生成手順は大きく下記5ステップです。

①プロンプトを入力する

どのような画像を生成したいか指示します。美女を生成するための例を用意しておりますので、まずは例をコピペして画像を生成し、そこからいろいろとアレンジを加えていくことを推奨します。

②ネガティブプロンプトを入力する

プロンプトとは逆にどのような画像は生成したくないかをネガティブプロンプトで指示することができます。例えば “extra fingers” や “fewer fingers” をネガティブプロンプトに入力することで、破綻しやすい指の本数を破綻しにくくする効果が期待できます。

③画像サイズや生成枚数等の出力設定をする

Batch count で生成する画像の枚数を指定したり、生成する画像のWidth(幅)とHeight(高さ)を指定をすることができます。また、Hires. fix(高解像度修正)で低解像度の画像を高解像度にアップスケールして全体的な品質を向上させることもできます。

④拡張機能の設定をする

ControlNet等の拡張機能をどのように使用するか設定することができます。

⑤”Generate”ボタンをクリックして画像を生成する

①~④の指示、設定が完了したら”Generate”ボタンをクリックして画像を生成します。

AI美女の生成(基礎編)

手始めに↓の例のような美女を生成してみましょう。

①プロンプトを入力する

プロンプト入力画面に下記プロンプトをコピペします。

1 girl solo, (8k, RAW photo, best quality, masterpiece:1.2), (realistic, photo-realistic:1.4), (extremely detailed CG unity 8k wallpaper), (blurry_background:1.3), blurry_foreground, depth_of_field, (ultra-detailed), (best illustration), (best shadow), ultra-high res, close-up photo, (detailed face:1.4), makeup, beautiful eyes, good-looking, smile, long hair, upper body, (colorful short shirt with off shoulder and lace trim:1.2), cleavage, small breasts, slim, perfect skin, Asian, standing, beach, seashore, palm_tree, water, summer, professional lighting

②ネガティブプロンプトを入力する

ネガティブプロンプト入力画面に下記プロンプトをコピペします。

easynegative, paintings, sketches, (worst quality:2), (low quality:2), (normal quality:2), low res, normal quality, ((monochrome)), ((grayscale)), skin spots, acnes, skin blemishes, age spot, glans, extra fingers, fewer fingers, strange fingers, bad hand, mole, ((extra legs)), ((extra hands)), bad-hands-5, watermark

③画像サイズや生成枚数等の出力設定をする

下記の通り設定します。

Batch count :1

Width : 450 Height : 650

Hires. fix : ✔

④Seed値の設定

Seed値を指定することで、生成される画像の再現性を確保できます。通常はランダム”-1″が設定されていますが、今回は例の画像と似たものを生成するために下記Seed値を入力します。

Seed値 : 1831933662

⑤”Generate”ボタンをクリックして画像を生成する

①~③の指示、設定が完了したら”Generate”ボタンをクリックして画像を生成します。

⑥生成結果の確認

WebUIの右部に生成結果が表示されます。下図の例のような画像が生成されていれば成功です!

※PCのスペックやモデルのバージョンなど様々な要因に生成結果は左右されます。例と全く同じでなくても雰囲気が似ている美女が生成できれば成功ですのでご安心下さい。

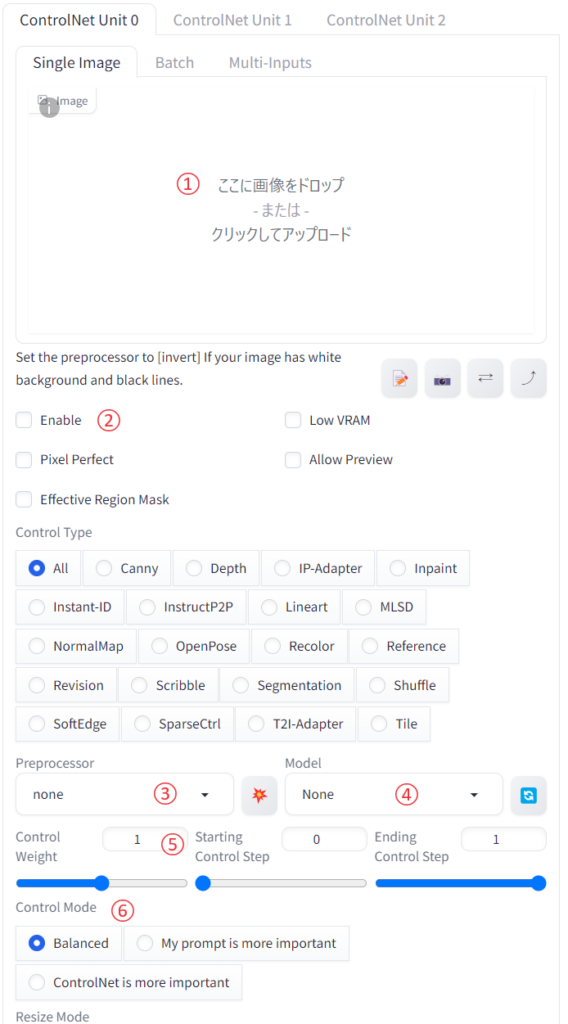

AI美女の生成(応用編)

応用編では拡張機能(ControlNetのOpen pose)を使用して↓の例のような美女を生成してみます。

手始めに↓の例のような美女を生成してみましょう。

●基礎編と同一の指示、設定をする

プロンプト、ネガティブプロンプト、画像サイズや出力設定は全て基礎編と同一に設定します。

●拡張機能の設定

ControlNetの設定箇所は主に下記6つです。

①画像をアップロードする

②Enableに✔を入れる ※この✔が入っていないとControlNetは生成する画像へ反映されません

③Preprocessorを選択する

④Modelを選択する

⑤Control Weightを設定する(値が大きいほどControlNetの影響が大きくなる)

⑥Control Modeを設定する

では、実際にやってみましょう。

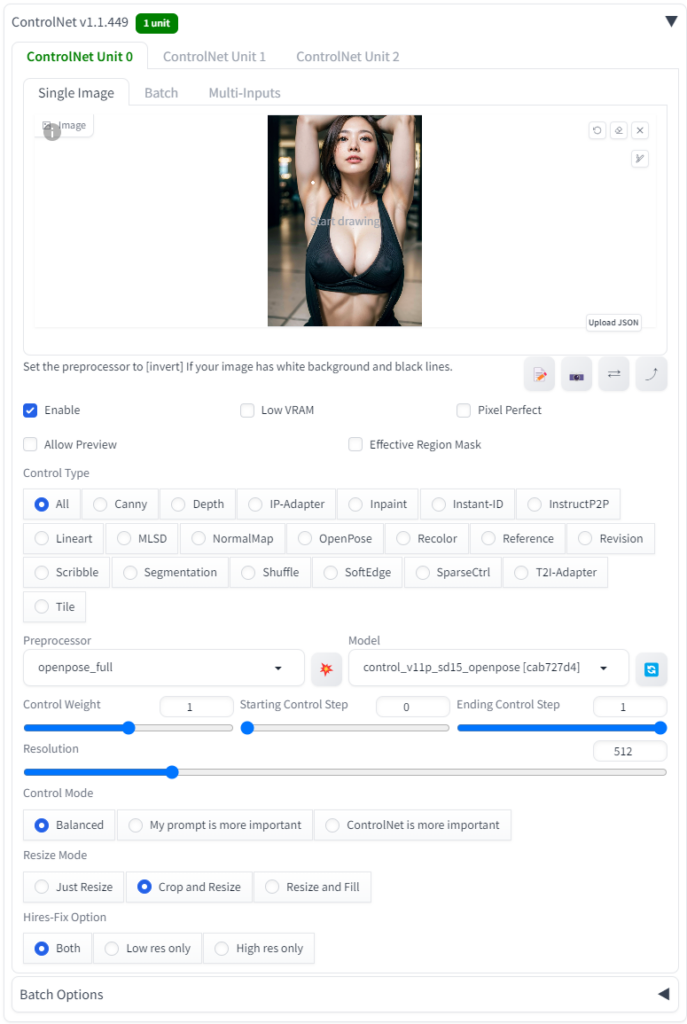

①画像をアップロードする

下図(両手を上げたポーズ)を使用して下さい。

②Enableに✔を入れる ※この✔が入っていないとControlNetは生成する画像へ反映されません

③Preprocessorを選択する

openpos_fll を選択します。

④Modelを選択する

control_v11p_sd15_openpose を選択します

⑤Control Weightを設定する(値が大きいほどControlNetの影響が大きくなる)

初期設定の”1”のままとします

⑥Control Modeを設定する

初期設定の”Balanced”のままとします。

以上でControlNetの設定は完了です。

●”Generate”ボタンをクリックして画像を生成する

WebUIの右部に生成結果が表示されます。下図の例のような画像が生成されていれば成功です!

※PCのスペックやモデルのバージョンなど様々な要因に生成結果は左右されます。例と全く同じでなくても雰囲気が似ている美女が生成できれば成功ですのでご安心下さい。

最後に

超簡単!画像生成AI 「Stable Diffusion」の導入と環境構築方法について解説をしてきました。

ここから様々なプロンプトを試したり拡張機能の設定を変更したりして自分好みのAI美女を生成して見て下さい。

生成した美女達はXをはじめとするSNSに投稿して是非グラビアアイドルAiに絡みにきてください!

皆さんとXで交流できることを楽しみにしています!